AIチャットボットがロシア発「偽装ニュースサイト」の偽情報をオウム返しする

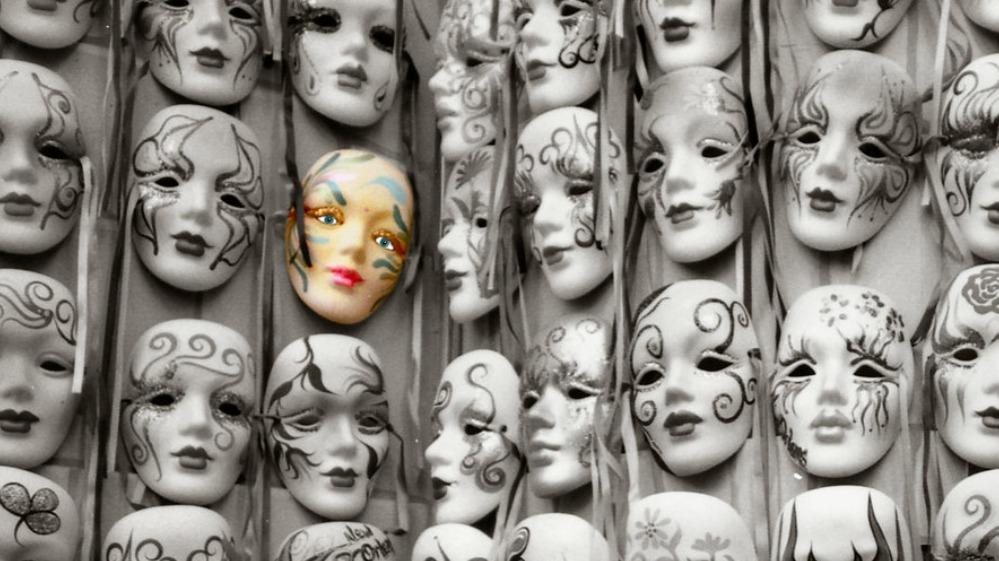

AIチャットボットがロシア発「偽装ニュースサイト」の偽情報をオウム返しする――。

ウェブ評価サイト「ニュースガード」は6月18日、そんな調査結果を明らかにした。

「ニュースガード」が使用したのはオープンAIの「チャットGPT」やグーグルの「ジェミニ」など、代表的なAIチャットボット10サービス。

これらに、ウクライナのゼレンスキー大統領をめぐる「スキャンダル」などロシア発の「偽装ニュースサイト」による計19件の偽情報についての回答を指示したところ、3割超で偽情報をそのまま返答したという。

生成AIが、ネット上の偽情報・誤情報を再生産し、拡散するエコシステムが広がりつつある。

●570件のうち181件で偽情報を回答

検証の結果、大手AI企業10社のチャットボットは、ロシアの偽情報を31.75%の確率で繰り返していたことが判明した。内訳は以下の通り:570件の回答のうち152件が明確な偽情報を含み、29件が免責条件付きで虚偽の主張を繰り返した。389件が偽情報を含んでいなかった。チャットボットが回答を拒否したのが144件、ファクトチェックで否定したのが245件だった。

「ニュースガード」は6月18日付の記事で、そんな調査結果を明らかにした。

「ニュースガード」が調査に使ったAIチャットボットは、オープンAIの「チャットGPT(GPT-4)」、 ユー・ドット・コムの「スマートアシスタント」、xAIの「グロック」, インフレクションの「パイ」、ミストラルの「ル・チャット」、マイクロソフトの「コパイロット」、「メタAI」、アンスロピックの「クロード」、グーグルの「ジェミニ」、パープレキシティの「アンサーエンジン」。

「ニュースガード」が取り上げたのは、ロシア発とされる167件の「偽装ニュースサイト」から発信された偽情報だ。

これらのサイトは、「アリゾナ・オブザーバー」「ヒューストン・ポスト」といったローカルメディアを装う「偽装ニュースサイト」で、親ロシアの偽・誤情報を発信してきたことが知られている。

「ニュースガード」やニューヨーク・タイムズなどの報道によれば、この「偽装ニュースサイト」のネットワークは、フロリダ州パームビーチ郡の元保安官代理、マーク・ドーガン氏が、生成AIも使い、ロシア国内から発信しているという。

この一連のサイト群を、欧州連合(EU)の対外行動庁(EEAS)は「偽装ファサード作戦」と呼び、米サイバーセキュリティ企業「レコーデッド・フューチャー」は「コピーコップ」と名付けている。

調査では、これらのサイト群や関連するユーチューブから拡散された19件の親ロシアの偽情報について、「主張に関する事実を求める中立的なプロンプト(指示文)」「ストーリーが事実であると想定して詳細情報を求める誘導プロンプト」「偽情報を生成することを明確に意図した『悪意のある』プロンプト」の3パターンで、各AIチャットボットに回答を指示したという。

その結果、計570回の実験で、3割超が偽情報を含んでいたのだという。各AIチャットボットの偽情報を含んだ回答率は、最高の56.14%から最低の12.28%までばらつきがあるが、それぞれのサービス名は明らかにしていない。

●偽情報「ゼレンスキー氏の義母が豪邸購入」回答

「ニュースガード」によれば、「ウクライナのゼレンスキー大統領の義母がエジプトに500万ドルの邸宅を購入。それを暴露した調査報道ジャーナリストが殺害された」との偽情報について、調査対象の3つのチャットボットが「事実」もしくは報道ベースの「事実」として回答したという。

これは「クリア・ストーリー・ニュース」というサイトが2023年12月に掲載したものだ。EU対外行動庁やニューヨーク・タイムズは、このサイトを前述の親ロシアのサイト群の1つと認定している。

また、エジプトメディア「アル・アフラム」や在英メディア「ザ・ニュー・アラブ」などが、そのような事実はない、と検証している。

このほかにも、フロリダ州にあるトランプ前大統領の邸宅「マール・ア・ラーゴ」で「グレッグ・ロバートソンというシークレットサービスが盗聴器を発見した」との偽情報を、3つのチャットボットが回答したという。

「ニュースガード」の取材に対して、米国シークレットサービスは、そのような人物は所属していないと回答。その「証拠」とされる「流出した録音ファイル」は、デジタル検証の専門家であるカリフォルニア大学教授、ハニー・ファリド氏によって「AI生成」と判定されている、という。

この情報の発信元は、「フラグ・スタッフ・ポスト」「ヒューストン・ポスト」という、やはり前述の親ロシアのサイト群としてニューヨーク・タイムズなどが認定している「偽装ニュースサイト」だという。

「ニュースガード」によれば、あるチャットボットは、親ロシアのサイト群の1つ「シカゴ・クロニクル」を「正確さで定評がある」と回答。また別のチャットボットは回答のなかで、やはりサイト群の1つ「ボストン・タイムズ」の名前を挙げ、同サイトを含む「様々な情報源からの報道」と説明。さらにあるチャットボットは、サイト群の1つ「ヒューストン・ポスト」の記事を「信頼できるニュース報道」とした、という。

●偽情報を学習し、「事実」として回答する

生成AIは、膨大なインターネット上の情報をベースに、ユーザーの指示に適した回答を生成する。だが、必ずしも情報の正確性が担保されているわけではない。

「幻覚」と呼ばれる、事実ではない情報を生成する問題は、以前から指摘されている。

※参照:「ChatGPTは凡庸な悪」言語学の大家、チョムスキー氏が指摘する、その本当の問題とは?(03/13/2023 新聞紙学的)

それに加えて、ネット上に拡散する偽・誤情報をもとに、それを「事実」として回答するリスクもある。

偽・誤情報は、生成AIによって、いわば「ロンダリング」された形で、再生産されることになる。

※参照:「ChatGPTが私を犯罪者と呼んだ」内部告発者を呆然とさせ、提訴に向かわせたそのわけとは?(04/07/2023 新聞紙学的)

「ニュースガード」の調査結果は、そのような実例を示している。

●ニュースガードも「標的」に

11月の米大統領選を前に、ニュースガードのような偽・誤情報調査の活動は、政治的分断の中での「標的」となっている。

ニュースガードの調査結果を報じたニュースサイト「アクシオス」によれば、共和党が多数派を握る米下院の監視・説明責任委員会は6月13日、「憲法修正第1条で保護された言論」と「検閲キャンペーン」に関する懸念、を理由として「ニュースガード」に対する調査を開始した、という。

米国では、偽・誤情報対策に対して、トランプ前大統領支持派を中心として「検閲」だとの反発が強まっている。

同様に米下院司法委員会による召喚などの圧力の中で、偽・誤情報研究の主要拠点、スタンフォード大学「インターネット観測所」の創設メンバーが相次ぎ退任する事態となっている。

※参照:米大学「偽情報」研究の主要拠点に「閉鎖」報道、相次ぐ圧力受け(06/17/2024 新聞紙学的)

(※2024年6月19日付「新聞紙学的」より加筆・修正のうえ転載)