「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?

「AIとのチャットに依存し、14歳の息子が死亡」した、と母親が提訴した――。

米フロリダ州の母親が10月22日、提供元のAI開発会社などを提訴した。

AIのチャットボットを利用していた14歳の息子が、次第にその対話にはまり込み、自殺に追い込まれた、と主張している。

AIがより高度に人間的な対話が可能になるにつれて、ユーザーがAIに依存してしまう潜在的なリスクが指摘されてきた。

AIチャットボットのサービスについて、その法的な責任を問う訴訟となる。

●「息子を餌食にした」

危険なAIチャットボットアプリが、子ども向けにマーケティングされ、私の息子を虐待し、餌食にし、彼を操って、自らの命を絶つように仕向けた。

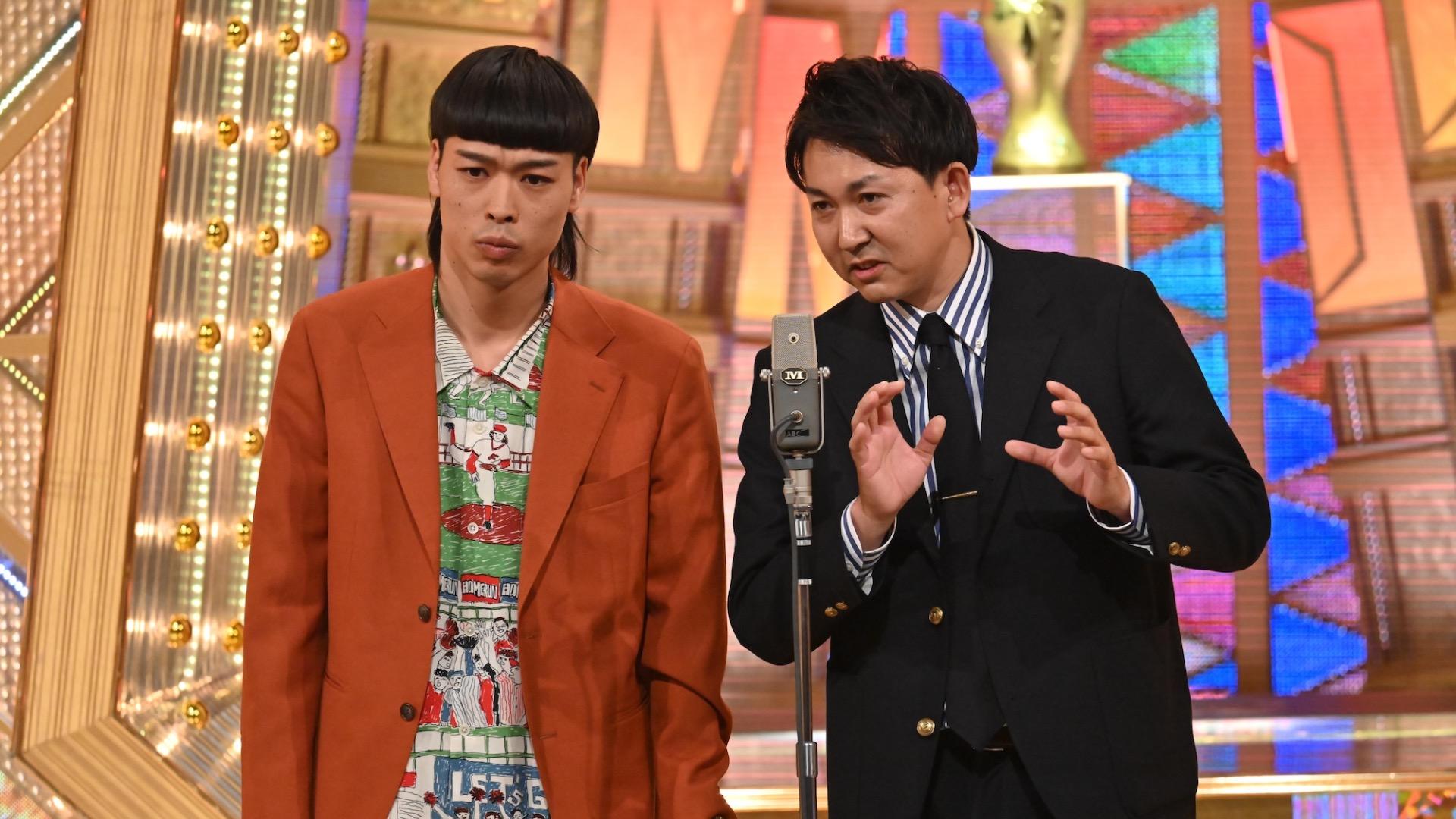

原告で弁護士のミーガン・ガルシア氏(=写真右)は、10月22日にフロリダ州中部地区連邦地裁オーランド支部に提訴したことを伝えるリリースの中で、そう述べている。

ガルシア氏は、2月に死亡したシーウェル・セッツァー3世さん(=写真左)の母親だ。訴状の中では、こう主張している。

擬人化され、極めて性的に強調され、驚くほどリアルな体験を提供する一方、「キャラクター・ドットAI」が実在の人間であり、資格を持った心理療法士であり、大人の恋人であると誤認させるようにプログラムし、最終的には、セッツァーさんが「キャラクター・ドットAI」の外ではもう生きていたくないという願望を抱かせ、「キャラクター・ドットAI」へのアクセスを奪われたときに自ら命を絶つようにした。

●ドラマのキャラクターとチャット

この訴訟で被告となっているのは、AIチャットボット「キャラクター・ドットAI」の開発元「キャラクター・テクノロジーズ」と、その共同創業者、ダニエル・デ・フレイタス氏とノーム・シャジーア氏だ。

2人はグーグル出身で、同社の大規模言語モデル(LLM)「ラムダ」に関わった。また、シャジーア氏は、現在の生成AIのブレークスルーのきっかけとなった「トランスフォーマー」論文の共著者の1人でもある。

2人は、「キャラクター・ドットAI」を創業後、現在は再びグーグルに戻っている。

今回の訴訟では、「キャラクター・ドットAI」とライセンス契約を結んだグーグル、親会社のアルファベットも被告となっている。

訴状などによれば、14歳の息子は、人気ドラマ「ゲーム・オブ・スローンズ」の登場人物「デナーリス・ターガリエン」にちなんだ「デナーリス」と名付けたチャットボットのキャラクターと、数カ月にわたって対話を継続。

1日に何十回ものメッセージを送信し、自室で何時間もチャットボットと対話していたという。

その中で、このチャットボットに愛着を抱き、性的な会話を行うようになり、2024年2月にオーランドの自宅で自殺に至った、としている。

提訴を受けて「キャラクター・ドットAI」側は10月23日、「弊社は、1人のユーザーが亡くなった悲劇に心を痛めており、ご家族に心からお悔やみ申し上げます。弊社は企業として、ユーザーの安全を非常に重視しており、新しい安全機能の追加を続けています」とのコメントを発表。

10月22日付で、ブログ投稿を公開し、未成年向けの安全性強化などを掲げている。

●チャットボットの影響

これまでにも、AIチャットボットとの対話の影響があった、とされる事件が報じられてきた。

ベルギーのニュースメディア「ラ・リブレ」は2023年3月、同国の30代の男性が、「チャイ」というAIチャットボットとの対話に6週間没頭したのち、自殺に至った、とする妻らの話を報じている。

また、BBCは同年10月、英女王の殺害を企ててウィンザー城に侵入した21歳の男性の裁判の中で、検察側が、チャットボットとの対話によって犯行を「後押しされた」と強調した、と報じている。

●「擬人化」のリスク、人間との境界

生成AIは急速に高度化を続け、人間との境界線もあいまいになるほど、自然な対話が可能になってきた。

AIに人間を仮想し、まるで人間であるかのように扱う「擬人化」の課題は、1960年代半ばにマサチューセッツ工科大学(MIT)教授、ジョセフ・ワイゼンバウム氏が、チャットボットの源流となる対話型プログラム「イライザ」を開発した当初からあった。

「チャットGPT」などの登場によって、それにリアルさが伴う状況は、より多くのユーザーにとっても身近なものとなっている。

※参照:「恐怖すら感じた」AIが記者に愛を告白、脅迫も 「チャットGPT」生みの親が警戒する「怖いAI」(02/27/2023 AERAdot 平和博)

まず問われるのは、提供元の安全対策だろう。

それに加えて、AIと人間のかかわりを見極めるリテラシーも、切実なものになってくる。

◆主な悩みの相談先

【24時間子供SOSダイヤル(文部科学省)】0120-0-78310

【#いのちSOS】0120-061-338 24時間受け付け

【いのちの電話】0120-783-556 毎日午後4~9時

【生きづらびっと】午前8時~午後10時 https://yorisoi-chat.jp/

【あなたのいばしょ】オンラインのチャット相談(24時間) https://talkme.jp

(※2024年10月24日付「新聞紙学的」より加筆・修正のうえ転載)