「AIリスク」を指摘する座談会記事をフェイスブック(のAI)が排除する

「AIリスク」を身をもって実感する、貴重な体験をした。

フェイスブックに2カ月程前にした書き込みが「この投稿はコミュニティ規定に違反するため、あなた以外には表示されません」とのメッセージとともに、知らぬ間に非表示にされていたのだ。

投稿の内容は、「AIリスク」の問題をめぐる専門家の方々との座談会の採録記事の紹介とリンクだ。

「コミュニティ規定違反」とあるが、具体的な違反箇所の指摘はない。

フェイクニュース拡散に対する国際的な批判から、コンテンツ規制に力を注ぐフェイスブック。その取り組みにはAIが使われているという。

非表示とされた座談会は、まさにAIに潜む差別や偏見、一方的に行われる判定の不正確さなどの問題にどう取り組むべきか、というテーマについて議論を行ったものだ。

そんな懸念が杞憂ではないことを、フェイスブック自らが示してくれた。

フェイスブックのコンテンツ規制は、かなり混乱しているようだ。

●AIの差別と偏見の問題を指摘

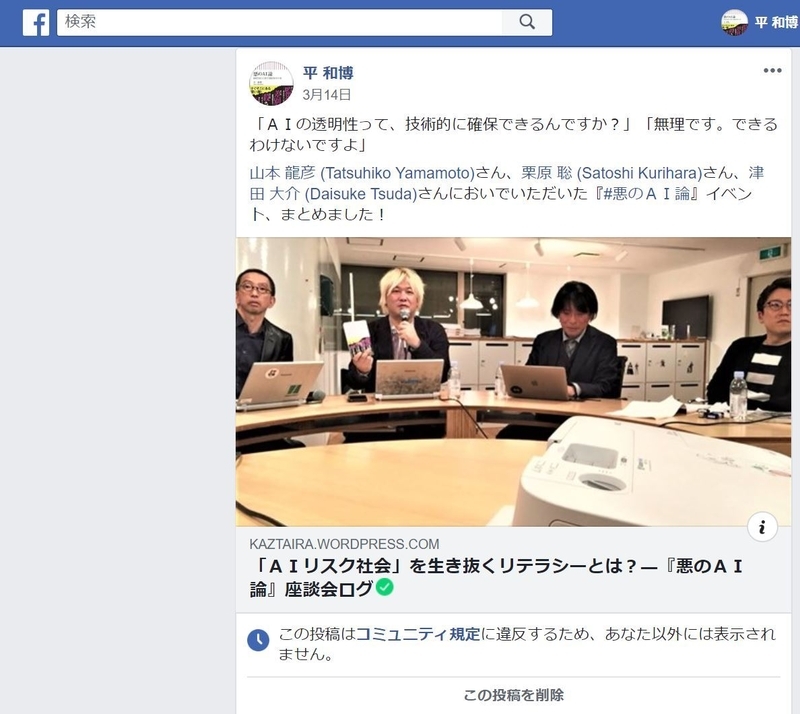

フェイスブックが非表示の措置を取ったのは、私が3月14日午前9時28分に一般への「公開」設定で投稿した座談会の記事紹介だ。

下記の紹介文とともに、座談会の採録記事へのリンクとアイキャッチ画像(OGP)が添えてある。

「AIの透明性って、技術的に確保できるんですか?」「無理です。できるわけないですよ」

山本龍彦さん、栗原聡さん、津田大介さんにおいでいただいた『#悪のAI論』イベント、まとめました!

※参照:「AIリスク社会」を生き抜くリテラシーとは?―『悪のAI論』座談会採録(03/14/2019)

この座談会は、紹介文にある通り、「AIリスク」をテーマに今年2月にまとめた拙著『悪のAI論 あなたはここまで支配されている』の出版にあわせて、栗原聡さん(慶應義塾大学理工学部教授)、津田大介さん(ジャーナリスト/メディア・アクティビスト、早稲田大学文学学術院教授)、山本龍彦さん(慶應義塾大学法務研究科教授)の3人の専門家の方々に集まっていただき、事件、技術、ネット、憲法などの切り口から議論を行ったものだ。

議論の中心となったのは、ブラックボックス化したAIのアルゴリズムが抱える問題だ。

差別や偏見が潜んでいるかもしれないAIのアルゴリズムを、外部から検証するのは極めて困難だ。

そして、この不透明なアルゴリズムによって、就職やローンなどで不利益な判断を下され続けていても、それを知ることもできず、異議申し立てをすることもできない。

そんな「AIリスク」にいかに取り組んでいくか、が議論のハイライトだった。

その議論の様子を、当日の会場の写真とともに2万7000文字ほどでまとめたのが、当該の記事だ。

●「あなた以外には表示されません」

その投稿を、5月8日に確認したところ「この投稿はコミュニティ規定に違反するため、あなた以外には表示されません」とのメッセージが出ており、投稿日時を欄の横にあるべき「公開」や「友達」を示すアイコンが消えている状態だった。

この事態に5月8日の朝に気づき、指摘してくれたのは、同じ記事をフェイスブックで共有してくれていた東洋大学教授の小笠原盛浩さんだ。

私も念のために自分の投稿を確認したところ、同じ理由で「あなた以外に表示されません」となっていることが確認できた。

状況把握のために、同じ座談会記事のリンクを、5月8日午前8時32分にも投稿してみたところ、これはしばらく表示が続いているようだ。

フェイスブックからのメッセージ「コミュニティ規定」のところにはリンクが張られており、「規定違反」の類型が表示されている。

具体的には、「1.暴力行為に関する信憑性の高い発言」「2.危険な人物および団体」「3.犯罪の助長と宣伝」「4.危害を加えるための計画」「5.規制品」「6.自殺と自傷行為」「7.児童のヌードと性的搾取」「8.成人に対する性的搾取」「9.いじめ」「10.嫌がらせ」「11.プライバシー違反と画像のプライバシー権」「12.ヘイトスピーチ」「13.暴力や過激な描写を含むコンテンツ」「14.成人のヌードと性的行為」「15.性的行為の勧誘」「16.残酷で配慮を欠いたコンテンツ」「17.スパム」「18.虚偽」「19.フェイクニュース」「20.追悼アカウント」「21.知的財産権」「22.利用者のリクエスト」「23.その他の未成年の保護」の23項目だ。

ただ、投稿のどの部分が、この23項目のどれに該当したかは、知る由もない。

●AIと7500人が判定

フェイスブックは「コミュニティ規定違反」をどのように判定しているのか。

2018年4月26日に公表した「コミュニティ規定違反を判断する社内ガイドラインの公表と申し立てプロセスの拡充」の中で、その手順をこう説明している。

コミュニティ規定に違反している可能性のある投稿、写真、その他のコンテンツを特定するために、利用者の皆様からの報告と人工知能(AI)を活用しています。これらの報告は、40以上の言語に対応しているコミュニティオペレーションチームが24時間365日体制で精査します。現在、前年同期比40%以上増の7,500人が精査しています。

AIの判定、ユーザーの報告、さらに7500人の人間の判定チーム。

ただ、同じ文面の中には、気になるこんな表現もある。

判断を間違う大抵の理由は、判断の過程には人が関わっており、そして人は時に誤った判断をする可能性があるからです。

フェイスブックとしては、人の判定よりもAIの判定を信頼している、ということだろう。

そして実際には、どこでどのような判定が行われたのだろうか。

●ピュリツァー賞写真を削除した経緯も

フェイスブックは、この数年のフェイクニュース拡散とコンテンツ規制の取り組みの中で、様々なトラブルを引き起こしている。

2016年夏には、ベトナム戦争時に当時9才の少女が、全裸でナパーム弾の攻撃から逃げてくる姿を捉え、”ナパーム弾の少女”として知られるピュリツァー賞受賞の報道写真を、「児童ポルノ」として相次いで削除。

※参照:フェイスブックがベトナム戦争の報道写真”ナパーム弾の少女”を次々削除…そして批判受け撤回(09/10/2016)

それ以降も、旧石器時代の裸婦の彫像の画像を削除するなど、ちぐはぐな対応が続いていた。

※参照:フェイスブックにとってわいせつとは何か?「旧石器時代のビーナス」から「世界の起源」まで(03/03/2018)

また、フェイクニュース拡散への国際的な批判の中で、今年3月には、マーク・ザッカーバーグCEOが、ネット上のコンテンツ管理について、新たな法規制導入を政府に要望するという寄稿をワシントン・ポストに掲載している。

※参照:フェイスブック、広告主が意図しないユーザー選別による「差別」(04/07/2019)

だが、政府に法規制を要望する前に、社内でやるべきことがあるようにも思える。

(※2019年5月8日付「新聞紙学的」より加筆・修正のうえ転載)