衛星画像の「影除去」から解析まで オンリーワンのAI・ディープラーニング技術

'''衛星画像の「影除去」から解析まで

オンリーワンのAI・ディープラーニング技術

株式会社Ridge-i 柳原 尚史'''

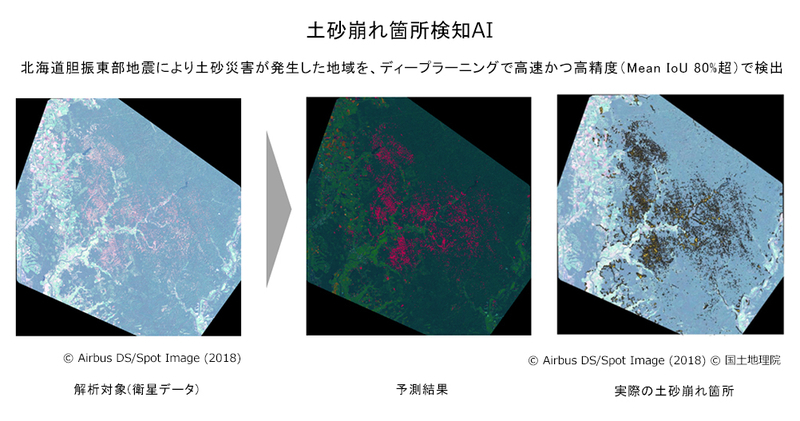

災害発生時に「緊急で発生箇所を知る」ことができれば、その後の対応に大きな力になります。2019年にJAXAからの委託により、光学衛星画像からディープラーニングを活用した解析により、土砂崩れ箇所を自動で検出する技術を開発し、第4回宇宙開発利用大賞で経済産業大臣賞を受賞した株式会社Ridge-i(リッジアイ)。広域を1分前後で高速解析し、約80パーセントの高精度検出が実現しました。熟練の検査員が目視で行っていた作業を自動化、高速化するとその先にどんな世界が開けるのか。代表取締役社長の柳原尚史さんに伺いました。

--災害箇所の検出を広域で1分前後、そして80パーセントの高精度で検出することができたとのことですが、広域というのはどのぐらいの広さですか?

柳原:被災地域を含む約2万平方km(約150km x 150km)の地域です。検出した「正解」は被災後に飛行機を飛ばして、国土地理院が土砂災害を観測した部分が正解の場所になります。ピクセル単位で土砂崩れの「ある/なし」を見極めるのですが、正解ラベルと1ピクセルでもずれると不正解になってしまう厳しい指標です。その正解ラベルと私たちが予測した部分がピクセルごとに一致した部分が80パーセントありました。

これから光学衛星画像に加えて、合成開口レーダー(SAR)のデータも多く市場に出てきます。しかし、その解析には人間が目を凝らして何とか確認ができるレベルで、毎日行うには限界があるのでより自動化のニーズが増えます。ですが、見つけたいものと、以前からそこにある自然の事物を区別するような場合、従来の手法で一つずつルールを設定するシステム開発ではキリがないので、ディープラーニングを使えば、こういう微妙な違いも見分けることができます。特にSAR画像のような人目やロジックで識別することが難しいタイプには特に有効ではないかと思います。

本技術は、より広域な範囲を解析することも可能であり、また、解析速度についても高速化する余地は十分にある点と考えています。

--ディープラーニングを使うメリットというのは、広域を高速に解析できるだけでなく、人間の手間を解消できるのですね。

柳原:人の手間がかからないという部分は大きいですね。たとえば昨年の台風19号のようなケースですと、非常に広域で災害が起きています。日本全国、あるいは海外も含めて土砂災害があった場合に、人の目に代わってディープラーニングによる解析を行うことで、衛星データをより効果的に活用できる可能性があると思っています。

災害直後はスピードが命ですが、いつ起きるかわからない災害に対して常に人が待機しているわけにもいきません。そうした負担も解消できればいいなと思っています。

--解析をはじめられたきっかけはどこからですか? 他にもこういった事業を手掛ける企業はあるのでしょうか?

柳原:災害時に衛星データを解析しているJAXAのチームから、災害検出をどれだけ効率化できるか一緒に研究したい、とお話しがあったのがきっかけでした。他社で衛星データを災害用途でディープラーニングを使って解析された事例は聞いたことがないので、知っている限り当社がオンリーワンだと思います。

--AI・ディープラーニング技術のコンサルティングと開発を行うために会社を設立してから衛星画像解析へ。なぜこの分野へ入ってこられたのでしょうか?

柳原:私のキャリアを通して、まずは通信、それから金融という、分野は違いますが重要な社会インフラの分野を経験してきて、社会を支えるインフラを技術でどのように良くしていくか、ということがライフワークになっています。防災、安心安全、スマートシティなどの社会課題に関して、技術を元に発展していく方向性を考えるのが好きですし、得意です。

もともと宇宙への関心はあったのですが、先端技術を使って社会課題を解いていくというミッションと、宇宙産業における衛星のトレンド、そしてAIの強みというのは非常に相性がいいと思いました。これには衛星コンステレーションといわれる複数の衛星が同一軌道を飛んで非常に高頻度で大量のデータを取っていくという流れがあります。高頻度、高解像度化によって大量の画像データの中から小さな変化を見つける必要があり、データの多様化に伴い、センシング自体が拡張して可視光もあればSARもあるという状況になってきています。AI・ディープラーニングは大量かつ複雑な因果関係があるようなデータに対してとても有効です。そこで、2017年ごろから衛星を使った場合にはこういうことできるのではないかという提案をするようになりました。

--災害対応に加えて、ビジネス分野でも衛星画像解析を手がけられていますね。

柳原:私たちはディープラーニングを中心としたさまざまなソリューションを作っています。衛星データから土砂災害の分析に加え、農作物の作付け分類といったものも行っています。研究開発ではSARを使った船舶の検出などもありますし、マーケティングに近い分野では、駐車場予約アプリ「akippa」を運営するakippa株式会社様と、衛星画像プラットフォームの「Tellus」を運用するさくらインターネット株式会社様と共同で駐車場の候補地を見つけるということを行いました。

この場合、ただの空き地を全て駐車場候補地にしてはいけないので、ディープラーニングの解析結果だけでなく様々な制約をかけあわせる特別なロジックを用意しています。当社ではさまざまな課題に対して、まずどこまで解析ができるかを見極め、そして目的に合わせてディープラーニングとそれ以外の技術を組み合わせて、一本のソリューションとして提供できるのが私達の一番強みではないかと思っています。

今後の展開に向けては、さまざまなプレーヤーと話しているところです。衛星画像解析にはGISソフトなどのツールを使って分析することが主流なので、既存のフローにうまく組み込んで効率化できるような、そういったものを作ろうとしています。

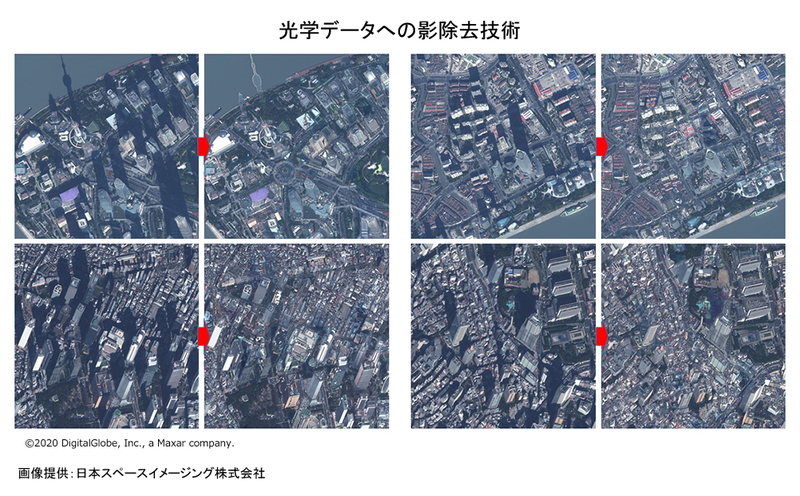

その一例として、最近開発した技術が「影除去」AIです。衛星画像にとって、影と雲、それから観測時間はノイズになりやすいのですが、継続的に衛星データ解析を運用していくのであればそのような課題をどう処理するかは非常に重要な課題です。ならば影に特化した前処理AIを作ろうと考えました。今回開発したものは、衛星画像が影で隠れている情報を表示させるもので、処理前の画像は影で一部が見えづらくなっていますが、影の中にうっすらと浮かび上がる正しい情報だけきちんと抽出して表示させています。このような前処理のツールを使えば、解析をする際にボトルネックとなりやすい作業を解消して、見つけたい事象を瞬時に解析できたりします。

--一方で、ごみ焼却場でごみ袋を分別するAIを作られたりしていますね。どのようにつながってくるのでしょうか?

柳原:実は、土砂崩れ災害検出のAIもごみ識別のAIも技術はまったく一緒なのです。ディープラーニングの中でも「セグメンテーション」と言われる、ピクセルごとにラベルを付けていく技術です。ごみ焼却場の場合、破れているごみ袋と破れていないものを見分けてそれぞれラベルを付けます。そして破れているごみ袋の中には何ごみが入っているか? とまたさらにラベルを付けていきます。これは2年ほどかけて開発したシステムですが、実際に船橋市でもう1年以上無事故で動いています。

これを開発していたときの目標も災害検出の時と同じで、ごみの焼却というのは、ごみによっては燃やすと有毒ガスが出たり、濡れたごみがあると焼却炉の燃焼に影響がでたりします。ごみを扱っている人たちは24時間365日膨大なごみを監視し、状況に応じて判断・対応を迫られる大変な作業なのです。そうした負担を少しでも減らしたい、という想いがありました。

--防災、減災というところにも通じるわけですね。

柳原:もし、日本で精度の高い土砂災害発見AIができれば、海外でも使える可能性は高いと考えています。日本の強みは、罹災後に非常に精緻に航空写真や現地調査などで土砂崩れの発生箇所を観測し、それらを蓄積しているところです。このデータを利用できることが本当に重要ですが、解析が属人的な技術になってしまうと海外に応用できなくなってしまいます。そこで何とかAIがその判別ロジックを吸収して、たとえばアジアで起きた災害にも使えないか、そうした仮説の検証ができたら良いと考えています。我々のような小さなベンチャーがどこまで届くのかはわかりませんが、そのようなことを考えながら取り組んでいます。

--衛星画像解析というと、元になる画像の入手はどうされていますか?

柳原:複数の衛星事業者と連携しており、必要な場合は購入しますし、災害時の緊急観測の場合は無償配布のものを利用します。画像形式になってしまうとデータとしては欠損が多くなるので、いかにRAWデータに近いものを使えるかが大事な部分ですね。

今後は緊急観測した場合に、どの衛星が最も高解像度で撮像できてそうか等、もっと調べて試してみたい分野が沢山あります。

--今後の課題は?

柳原:多時点間のSAR画像へのディープラーニングの応用はまだまだ研究の余地の多いフィールドだと思っています。外乱に弱く、データに非常にノイズが入ると思うので解析対象次第という感じになると思っています。

--そのためのデータ供給、課題はどんなところでしょうか?

柳原:商業用ですとスポンサーが分かりやすいですが、災害は非常に公益性が高い分野で、常に私たちがボランタリーでできるわけではないので、その点はまだいろいろと模索しています。

衛星画像解析は、少し試すだけでも1シーン十数万円もかかってしまうのが現実です。災害という広域の事象を対象にするには、このあたりをどう解消するかが課題です。衛星事業者によって、いつどこを観測しているかはまちまちですし、フォーマットも異なります。撮影角度によっては画像に映りこんでいる影もかなり大きな課題で、影が多いと購入した画像を最大限活用できないといったことが発生します。

また現状では、解析技術のノウハウが私たちや他の解析事業者に分散してしまっていて、土砂災害に対するベストプラクティスのようなものが蓄積されない構造になっています。衛星データ利用というのはさらに盛り上がりそうな分野にも関わらずそうでもないのは、おそらく「画像取得コストがかさむ」「データに雲・影・天候影響などのノイズが多い」「解析技術が様々なプレーヤー間に分散されている」、この3つの課題に集約されるような気がしています。

--特に最初の画像取得コストの部分で、今後打ち上げられる地球観測衛星や衛星画像プラットフォームのTellusに期待される部分はありますか?

柳原:衛星画像による土砂災害の解析にとって、航空機から観測してラベル付けしたデータというのは、ラベル付けの論拠となったデータソースと解析するデータソースが異なってしまう点で、必ずしも良い正解データとは限りません。そこで、何のデータを撮りためておくと中長期的に災害データ解析の知見が蓄積できるか、という観点で最初から設計に入った方が良いと考えます。例えばある地点を光学、SAR両方で撮っていれば、精度の高い光学の情報を元に、雲で見えない部分はSARで補完できる等、どういったデータペアを蓄積していくか、という点でより発展的になります。そうした、AIという視点で今後の衛星に「こういう機能があるといいのではないか」といった提言も機会があれば発信していきたいと思います。

--今後、どのような技術や分野に挑戦されたいですか?

柳原:今やっていることは、ある特定時点のデータを、高速に解析するところが中心です。スピードは大事なことですから、高速解析をさまざまな事例で続けていきたいです。

それから、今度は時系列的に、二時点間、三時点間、または一年間、そういった継続的なデータから何が見えてくるかを知りたいです。災害、特にその予兆のようなものの場合、より細かいところの変化に気づく必要があります。時系列的に増えていくデータから自動的に異常や変化を抽出する「異常検知」といったものはやってみたいことのひとつです。これは衛星コンステレーションが実現すれば可能になりますが、今はデータの取得コストが掛かりすぎることが社会的にもボトルネックになっています。どこに何が隠れているのか分からないデータから検出しなくてはならない、となると、すべてのエリアのデータを買わなくてはならないため、世の中でもほとんど試せていない分野だと思いますね。

また、光学とSARのような組み合わせ、「路線価」「モバイル空間統計」のように衛星以外のデータを組み合わせて何が見えるか、にも興味があります。衛星データ解析はまだほんの一部しか実現していないと思うので、これからやれることはたくさんあると思います。

主な衛星搭載地球観測センサーの種類

光学センサー:可視光から赤外域の太陽光によって観測する受動型センサー。太陽光が地上の物体に当たって反射する可視光線や近赤外線をとらえて観測する。カメラと同様に地上を光学画像として表現し、植物の分布や河川や湖沼、市街地等といった地表の状態を知ることができる。太陽光を利用するため、夜間の観測、雲の下の地表の様子を観測することはできない。日本では陸域観測技術衛星「だいち1号(ALOS)」搭載の「PRISM」「AVNIR-2」、今後打ち上げ予定の先進光学衛星「だいち3号(ALOS-3)」搭載の広域・高分解能センサーなどがある。だいち3号搭載センサーの観測性能は、白黒(パンクロマチック)センサーは分解能0.8m、観測幅は70kmとなっている。

SAR:Synthetic Aperture Rader(合成開口レーダー)の略称。マイクロ波を地表に対して斜めに照射し、地表から衛星に向かって反射する電波によって観測する能動型センサー。地表の起伏を捉えることができ、地盤の変化や構造物の種類などを知ることができる。マイクロ波は雲を通過することができ、天候に左右されず地表の観測ができる。また衛星自身がマイクロ波を発するため太陽光のない夜間でも観測可能。波長の長い順にLバンド、Cバンド、Xバンドの帯域を用い、日本では陸域観測技術衛星「だいち1号(ALOS)」搭載の「PALSAR」や陸域観測技術衛星「だいち2号(ALOS-2)」搭載の「PALSAR2」などがある。PALSAR-2の観測性能は分解能が最高で1m×3m(スポットライトモード)、観測幅は最大で490km(スキャンモード)。

※本記事は宇宙ビジネス情報ポータルサイト「S-NET『衛星画像の「影除去」から解析まで オンリーワンのAI・ディープラーニング技術 株式会社Ridge-i 柳原 尚史』に掲載されたものです。