静岡県の水害にまつわる「AIデマ画像」が拡散 災害時のデマ、フェイクニュースからどう身を守る?

水害や地震などの大規模災害時には、TwitterをはじめとしたSNS上に膨大な数の被害情報が投稿される。これらの情報を収集し、上手く精査することできれば、避難や早期復旧、二次災害の防止などに役立てることが可能だ。

総務省がまとめた令和3年版情報通信白書によれば、2016年の熊本地震(スマホ利用者)において、発災時にSNSを情報収集に用いたとする人が47.6%に達している。また、令和2年(2020年)には、60〜64歳と比較的高齢な層のSNS利用率が6割超に達し、65歳以上でも5割近くがSNSを利用しているとするなど、SNSの利用が若い世代に留まらず全年代に広がっていることが分かる。

その結果、高齢化の進む地方を含め、災害時にはSNS上に被害情報が多く投稿される状況が加速している。いわば、SNSが災害から身を守るために最重要な情報インフラになりつつある。一般市民も企業も、それらを活用しないわけにはいかない時代となっているわけだ。

しかし、こうした災害時にSNS上の情報収集における大きなリスクとなる「デマ画像」がAIによって生成され、多数のユーザーによって拡散される事態が生じている。

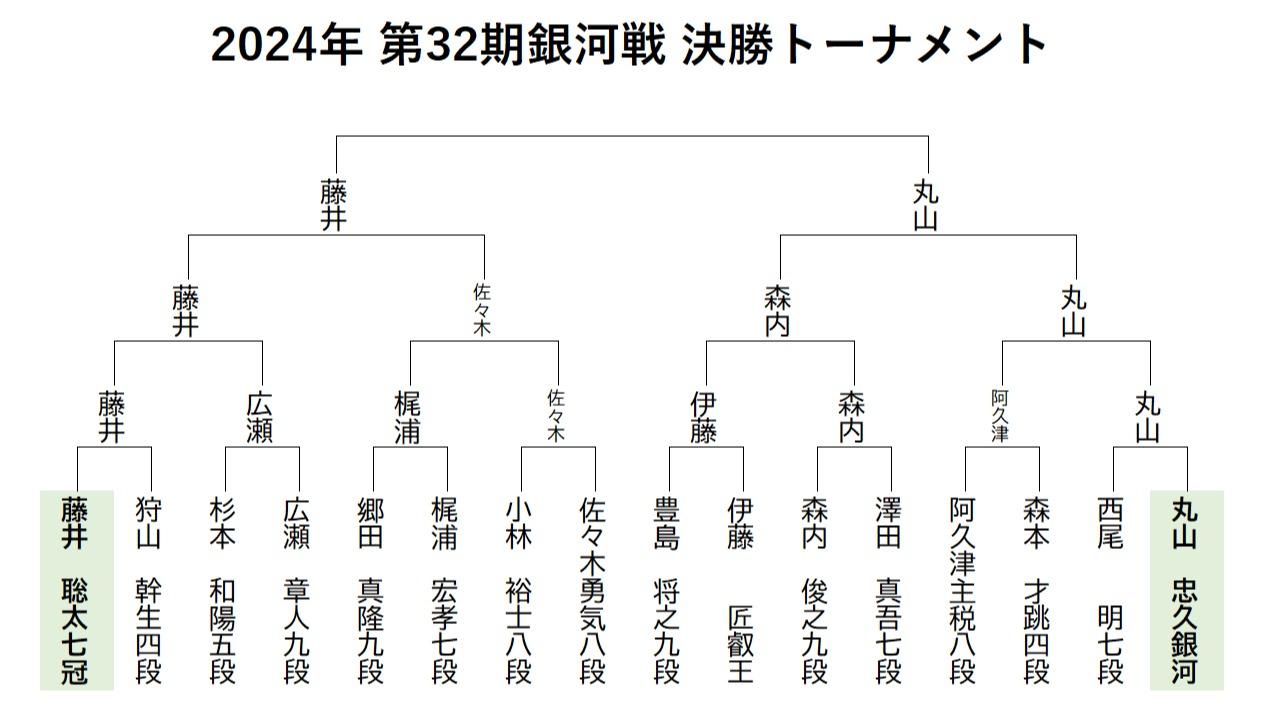

下記の画像は9月26日未明に「ドローンで撮影された静岡県の水害」とのコメント付きで投稿され、その後拡散されたものだ。投稿者によると、最近流行している画像生成AI「Stable Diffusion」などを利用して生成したデマ画像である、とのことだ。

実際、画像の内容をよく見ると、直線的であるはずの建物の屋根が奇妙な曲線を描いていたり、水没している箇所とそうでない場所の境界線が不自然である等、AIで生成された架空の画像によく見られる特徴がある。全体的に見ても、静岡県内の地形や実際の被害状況とは大きく異なる内容で、架空の地形の画像が「それっぽく」生成された可能性がある。

同一人物が投稿した他の画像では、水に腰まで浸かった人のような写真も投稿されているが、これもやはり人間の目からすると不自然に映るものだ。

災害デマ画像の投稿が二次災害につながる恐れも

このような災害時のデマ画像による弊害は決して小さくない。

近年は、報道機関や行政機関においても、SNSは一次情報を収集するうえで最も速く、且つ網羅的な情報源になりつつある。

筆者の経営する報道ベンチャーのJX通信社は、SNSやアプリ等から災害や事故、事件などの情報を収集するAIサービス「FASTALERT」を開発しており、静岡県内の全てのテレビ局と新聞社を含む、全国の大半の報道機関に情報を配信している。同様に、自治体にも同種の情報を提供している。下記画像の通り、静岡県内からSNSに多数の被害情報が投稿されていることが分かる。

ちなみに、上記で紹介した問題の画像は、FASTALERTでは情報を解析するAIの働きにより「デマの疑い」がある不自然な画像と判定されたため、災害情報としては配信されなかった。このためか、幸いこれらデマ画像が鵜呑みにされて報道されたケースはない。

だが、例えば、架空の被害情報をよりピンポイントに実在する地形に合わせて緻密に作り込んで投稿されるなどした場合は、AIでも見破れず「実際に災害の被害を写した可能性のある情報」として処理される恐れもある。

もし、仮にAIが見過ごしてしまったとしても、報道機関の場合は、SNSの投稿だけで実際のニュース報道に至ることはほぼない。一次情報をFASTALERTやSNSから得たとしても、現場での取材や当局への確認など経て報道するプロセスを必ず踏む。このため、最後まで騙されて報道に至るケースは極めて稀だ(但し、過去には現地取材に赴いたスタッフが、現地の住民からデマの写真を渡されて報道に至ったというケースはある)。

だが、最終的に誤報につながる可能性は低くとも、デマ画像の投稿によって、報道機関のみならず、行政機関も含め、災害の発生場所や情報自体の真偽の確認により時間や手間がかかることは間違いない。その結果、多くの被災者にとって重要な、伝えられるべき情報が伝えられなくなる恐れがある点には留意が必要だ。

更には、FASTALERTのようなAIを利用していない一般市民や企業の場合、そうしたデマ画像の真贋を手早く検証する有効な手段はほぼない。その結果、デマを信じてしまい、避難や復旧作業に支障をきたしたり、最悪の場合は二次災害につながる恐れもある。

災害デマの投稿は刑事罰に問われる可能性も

そもそも、SNSに災害の被害状況を騙るデマを投稿した者は、刑事罰に問われる可能性がある。

2016年に発生した熊本地震においては、Twitterに「動物園からライオンが逃げた」という趣旨のデマを写真とともに投稿した会社員の男性が、動物園の業務を妨害したとして偽計業務妨害の疑いで逮捕されている。だが、こうした前例があるにもかかわらず、今年も台風や大雨など、災害の被害が発生する度に架空の被害を訴えるデマ画像が投稿されるケースは後をたたない。

こうした、SNS上のデマ画像やフェイクニュースから身を守るにはどうすれば良いのだろうか。

その結論は、残念ながら情報の内容をよく観察、吟味するしかないというものだ。最近流行っている画像生成AIでは、市街地での災害の状況や、人工物を含む風景を模した画像を生成した場合、よく見ると直線的であるはずのものが曲線的に写っているなど、かなり大味な画像が出力される傾向にある。ただ、それでも引きで見ると一見自然に見えるため、今回の事案のように大きく拡散されてしまう。

災害時には情報量が爆発的に増えるため、情報を個別に観察、吟味するには限界がある。企業や行政機関でどうしても正確な見極めが必要な場合は、FASTALERTのようなAIによる情報のスクリーニング技術を活用するのも一手段だが、一般市民は情報は複数のソースで確認する、自治体や首長など行政の公式な発信を参考にするなど、一般的な情報リテラシーに基づく対策を再度心得る必要がありそうだ。