使いたくなければ、「ノー」と言えばいい…ついに、「Apple Intelligence」で露わになったアップル独自の戦略

スマホの中の個人的アシスタント

Apple Intelligenceの特徴の1つは、「デバイスの中で、アプリをまたいで動作する」ことだ。 基調講演では、次のような例が示された。 「母と私とオリビアが写っている写真を見せて」 「このあいだ、妻が送ってくれたポッドキャストを再生して」 「先週ジョズがシェアしてくれたファイルは?」 どれも、人間なら簡単に処理できるものばかりだ。だが、AIにとっては、「複数の人を見分ける」「あいまいな日付でファイルを探す」など、複数のアプリやデータにまたがる、かなり面倒な内容が含まれている。 これを処理するにはどうしたらいいか? 答えは、「各アプリごとに、どんなことがおこなわれたかの履歴を記録し、それらを活かして動作する」ことだ。 まさに「スマホの中にいる個人的なアシスタント」としてAIを機能させるのが、アップルの計画なのである。

他社の「オンデバイスAI」との違いは?

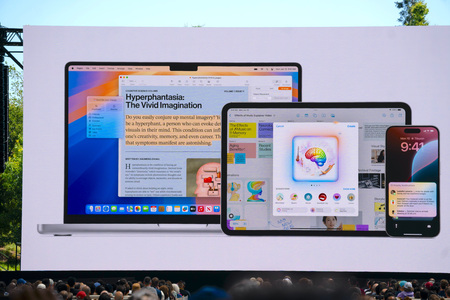

前回の記事で説明したように、「機器の中でAIを動かし、それを個人のアシスタントのように使う」という発想自体は珍しいものではない。マイクロソフトやGoogleも、自社のAIを「オンデバイス化」し、OSに組み込み始めている。 しかし、アップルには、他社とは違う点が2つある。 1つは「複数の機器に搭載している」ということだ。 Apple Intelligenceは、アップルが自社開発して製品に搭載している「Appleシリコン」で動作する。 より正確にいえば、MacやiPadで採用されている「M1からM4まで」のプロセッサーと、iPhone 15 Proシリーズに使われている「A17 Pro」に限定されており、「新しくて性能が高い」製品でのみ動作するかたちだ。 すなわち、Proシリーズではない通常のiPhoneでは動作せず、これは、アップルにしては「足切り」の基準がかなり高い方針だ。逆にいえば、今秋の発売が予測される「新型のiPhone」には、おそらくA17 Proと同等以上のAI処理性能をもつプロセッサーが使われ、Apple Intelligenceが動作するものになるだろう。