生成AIの法的リスクと対策|AIキャラクターに著作権はある? 違反したらどうなる? 弁護士に聞いた

私たちの日常に浸透しつつある生成AI。たとえば、伊藤園では2023年9月発売の新商品「お~いお茶 カテキン緑茶」のテレビCMに生成AIが作成したタレントを起用、「日本初の事例」として話題を呼んだ。 生成AIで作成したキャラクターや文章に著作権はあるのか。そもそも生成AIの開発・学習に個人情報や著作物を使用できるのか。何をしたら違反で、違反するとどんな罰則があるのか。

これらの疑問を『生成AIの法的リスクと対策』(日経BPマーケティング)の著者である西村あさひ法律事務所・外国法共同事業の弁護士 福岡真之介氏に聞いた。

法的リスクが高いのは、「著作権」「個人情報」「秘密情報」の違反

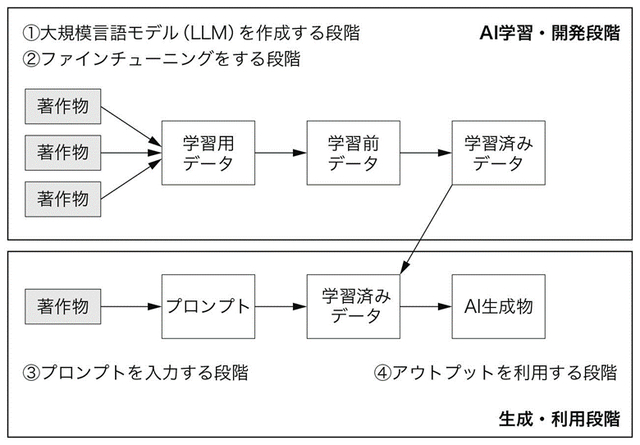

生成AIの製品には、主に次の3種類がある: ・文章生成AI ・画像生成AI ・音楽・音声AI これらは大量のデータからその特徴を学習し、プロンプト(入力)に応じて適切な結果を出力する「機械学習」の手法を用いて開発されている。 企業が生成AIを利用する場合には、ChatGPTなどの大規模言語モデルに追加で小規模データを学習させ、特定の用途に向けた学習済みモデルを作成する「ファインチューニング」を採用するケースもある。自社で大規模言語モデルを一から開発するのは技術やコスト的に難しいためだ。 といっても既存の大規模言語モデルには、ファインチューニング可能なモデルと不可能なモデルがある。そのため、AIから望ましい結果を得るために、プロンプトに自社に特化した情報などを含めるなどして最適化する「プロンプトエンジニアリング」の手法も注目されている。 これらを踏まえ、生成AIには次の4つの「利用段階」がある:

1. 大規模言語モデルを作成する段階 2. ファインチューニングをする段階 3. プロンプトを入力する段階 4. アウトプットを利用する段階

そのうえで生成AIの法的リスクを考えると、主に次の8種類があるという。 (1)知的財産の侵害・帰属 他人の著作権、その他の知的財産権を侵害する。生成AIの知的財産権が誰に帰属するのか不明確な場合がある。 (2)人格的権利・利益の侵害 肖像権やパブリシティ権・個人のプライバシー等を侵害する。 (3)個人情報の不適切利用 個人情報保護法に違反して個人情報を取り扱う。 (4)秘密情報の漏洩 自社や他社の秘密情報を漏洩する。 (5)誤情報の利用 生成AIが作成した間違った情報を利用して判断したり、その情報をAI利用者に提供したりする(主に生成・利用段階)。 (6)バイアスによる差別や不公平な取り扱い 生成AIが生成した差別的な情報を利用して判断したり、その情報をAI利用者に提供したりする(主に生成・利用段階)。 (7)フェイクニュースの流布やマルウェア作成等の不適切利用 生成AIによりフェイクニュースやマルウェアを作成し、それを流布する(主に生成・利用段階)。 (8)各種業法の違反 弁護士法・医師法・金商法等の業法に違反するサービスを提供する(主に生成・利用段階)。 福岡氏いわく、なかでも法的リスクが高いのは(1)知的財産の侵害・帰属、(3)個人情報の不適切利用、(4)秘密情報の漏洩の3つ。 現状、世界で起きている生成AI関連の訴訟も、この3つに関する内容が目立つ。たとえば、GitHubが提供する『GitHub Copilot』は、米国で著作権法やプライバシー法に違反しているとしてプログラマーから集団訴訟を提起されている。 これは、ユーザーであるプログラマーが書きたいプログラムコードを提案するAIサービスで、その学習用データは未公表だが、GitHubの公開リポジトリに登録されているオープンソースのコード(ユーザーが登録したコード)だろうと考えられている。 それらのコードは作者名と著作権帰属の表示が必要な可能性があるが、GitHub Copilotの出力には、これらが表示されていない。プログラマーたちは、これがライセンス違反にあたると主張している。 ちなみにマイクロソフトでは、大規模言語モデル (LLM) を組み込んだ自社の生産性向上ツール「Microsoft Copilot」に対して、法的リスクに対して責任を負う「Copilot Copyright Commitment」を2023年9月に発表している。Microsoft Copilotで生成した出力結果を使用して、著作権上の異議を申し立てられた場合、マイクロソフトが責任を負うわけだ。