人々は本当にフェイクニュースで騙されるのか?2024年の脅威として多くのセキュリティ企業が警告

2023年は生成AI元年とも呼べる年でありChatGPTの登場によって「生成AI」が話題を集めました。一方、「生成AI」は本物そっくりの画像や動画を生成する能力も備えており人々を騙す「フェイクニュース」の懸念も高まりを見せた年でした。

■多くのセキュリティ企業がフェイクニュースを2024年の脅威とした

2024年は米国では大統領選挙を控える重要な年でもあるため、多くのセキュリティ企業、特に消費者向けのセキュリティソリューションを手掛ける企業では「AI技術を活用したフェイクニュースの増加の警戒」を呼び掛けています。

2024年選挙を妨害するディープフェイク

マカフィーは、米国大統領選挙、インドの総選挙、欧州連合(EU)の議会選挙など、AIが生成した音声、動画、写真などディープフェイクによる詐欺が増加する中、有権者は情報の真偽を見極めることが求められるとしている。

引用:マカフィー社

音声ディープフェイクの増加

画像のディープフェイクが一般的になるにつれ、音声のディープフェイクの技術進化も加速しています。人間のような音声を生成する高度な機能を備えたOpenAIのText-to-Speech(TTS)APIが最近発表されたことは、人工音声技術の著しい進歩を浮き彫りにしています。一方で、こうした技術革新は悪用される可能性もあります。詐欺師は、より説得力があり思わずアクセスしてしまうような偽装コンテンツを作成し、ディープフェイク技術に関連するリスクを強める可能性があります。

引用:kaspersky社

ソーシャル・エンジニアリングが顕著になる

2024年はAIが生成したコンテンツをソーシャルメディア上で利用し、フェイクニュースや疑わしい広告、公人のディープフェイク、信頼できる人脈から発信されたように見せかけるダイレクトメッセージなどの手口が増えるという。

引用:ノートン社

■人々は本当にフェイクニュースで騙されるのか?

「AIが作成したコンテンツなんて私なら騙されない」そう思う人も少なくはないでしょう。米国でAIの脅威研究でリードするNetskope社が「2023年に世間を騙したフェイクニュース」に関する調査結果を発表しました。

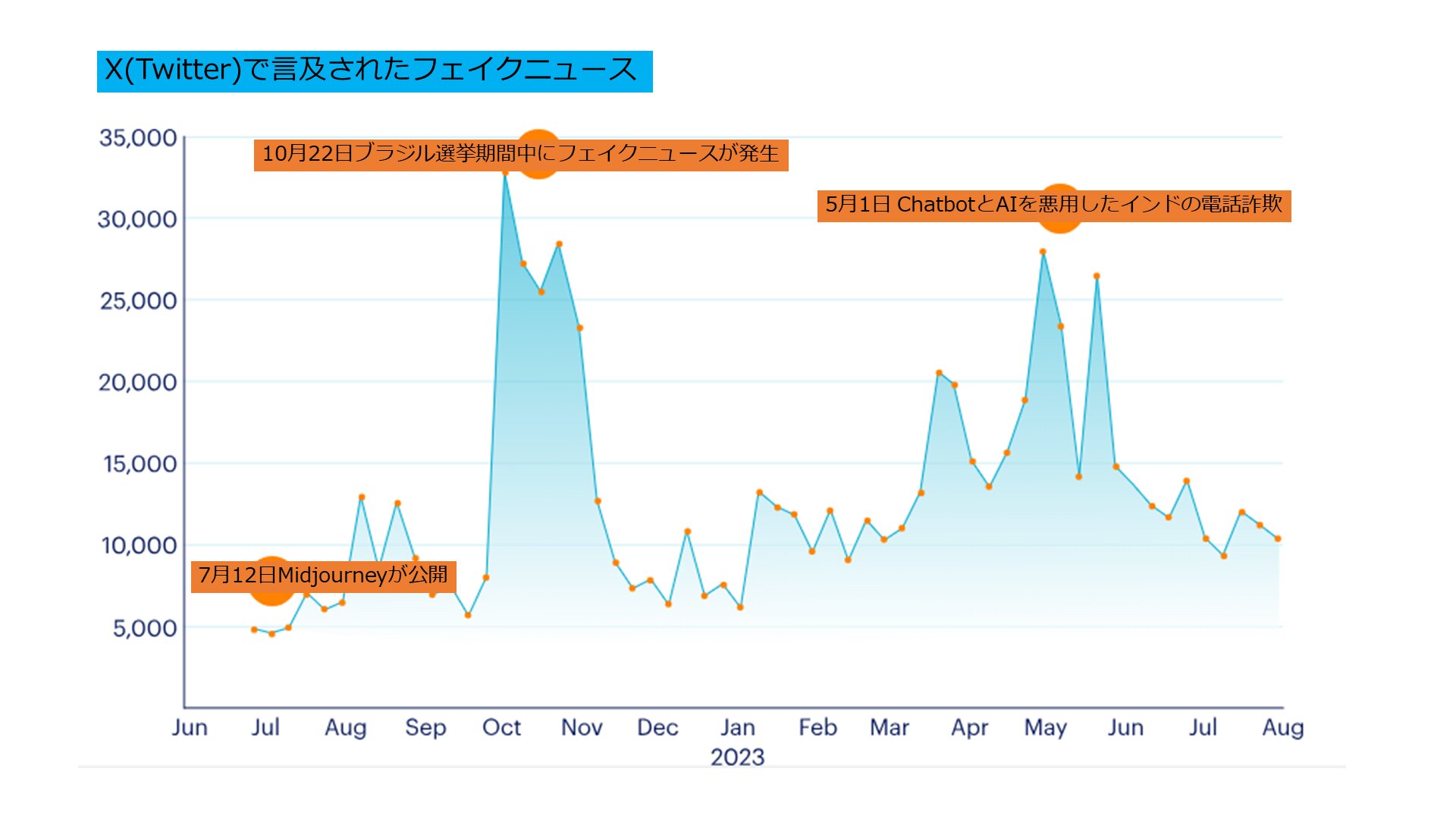

この調査によれば、2022年7月12日に画像生成AIサービスである「Midjourney」がオープンベータとしてサービスを開始した頃からフェイクニュースが世間の関心、特にSNS上で共有されることが多くなったとしています。

2023年に最も「世間を騙したフェイクニュース」は「ダウンジャケットを着たローマ教皇」であり、SNSでは2000万回以上閲覧され、312を超えるメディアに取り上げられました。

ローマ教皇の画像はジョークとして受け入れられましたが、2位となったドナルド・トランプ氏の逮捕を想像させるフェイク画像は「本物か?偽物か?」と議論になりました。

このフェイク画像はトランプ元大統領がポルノスターへの口止め料支払い疑惑に関連する記録偽造を巡り、ニューヨークの大陪審によって起訴される可能性があるとの報道の中で共有されたため、「フェイク画像に信憑性を持たせる"コンテキスト"」も備わっていたので、「本物ではないか?」と信じてしまう人も現れました。

■AIによるフェイクニュースを見破る方法

AIによるフェイクニュースを見破る方法はどのような方法が効果的でしょうか?幾つかのポイントをあげます。

・写真や動画は簡単に偽造出来ることを認識する

生成AIの普及前と、普及後の最も大きな違いは、もはや「"写真や動画"だけで事実かどうか判断するのが難しい時代」になっていると正しく認識することです。この認識がある人と、そうでない人では、フェイクニュースに騙される確率が大きく異なって来ることが容易に推測出来ます。

・物語の元の情報ソースを探す

意外性のある情報をSNSで見かけたら、まずは情報ソースを探す習慣を身につけましょう。

- SNSで発見した画像なら引用元のURLはあるか?

- その投稿者以外にも言及している人はいるか?

- 著名人の画像なら、本人のSNSで何か言及されていないか?

- 本物と確信が持てない場合は共有しない

・画像の場合の見分け方

判断に迷う画像があった場合には現在の生成AIは幾つか特徴があるので生成AIによるフェイク画像かを見分けるポイントを以下に記載します。

- 文字に潰れている箇所はないか?

現在の生成AIは文字を生成するのが苦手なため、つづりが間違っていたり、フォントが崩れている文字は無いかを確認しましょう。

- 詳細部分に誤魔化しはないか?

生成AIは顔等は綺麗に生成することが出来ますが、詳細部分の表現が苦手です。例えば歯や、目、指といった細かい部分に着目してみると「ぼやけていたり」誤魔化していることがあります。初期の頃は指の数が違うなど指摘されていました。本物の写真の場合は細部まで鮮明に写っていることが当たり前ですが、生成AIは「細かい部分はごまかそう」とする傾向にあるということを覚えておきましょう。

・動画の場合の見分け方

フェイク動画の作成は作成する側も、静止画像と比較するとコストがかかります。この点が見分けるポイントとなります。

- 動画の画像サイズは大きいか?

広く見てもらいたい動画の場合は大きなサイズで高解像度で作成することが一般的です。しかし、フェイク動画の場合は動画サイズが小さく、低解像度である場合があります。これはフェイク動画作成者が低コストのフェイク動画作成ソフトを利用している場合に該当します。

- 字幕の位置がおかしくないか?

フェイク動画はまだまだ品質的に低いこともあり、顔などをじっくり見られるとバレてしまうため、意図的に字幕を顔に被せ、細部に視線がいかないように作られてるいこことがあります。肝心の顔があまり見えない等の違和感を感じた場合には、フェイク動画であることを疑いましょう。

- 表情がおかしい

現在のフェイク動画では、音声や口の動きが一致していない、唇だけが動いているように見える等、良く観察すると人とは違う違和感があることがあります。唇やまばたき等に違和感が無いか注意するようにしましょう。

■フェイクニュースの本格的な悪用に警戒が必要

2023年時点ではフェイクニュースは「いたずら」的な要素が多く、明らかにジョークであるものや、投稿者自らがフェイクであることを明らかにしている事例が大半でした。

それでも少なくない人が「本物かもしれない」と思ってしまう人が居たのは事実です。

2024年は生成AIが登場してから初めての「大統領選挙」を迎える年となるので、多額の資金をかけたフェイク動画等が悪用される可能性がゼロであると言い切ることは出来ません。

生成AIの技術が進化し、より低コストで簡単に利用出来るようになれば、フェイクニュースは私達個人の身近に迫ってくるリスクが高くなります。これまで以上にITリテラシーを高めていく努力を続けることを推奨します。