AWSとマイクロソフトがクラウドサービスに導入 Mistralオープンソースモデルの強み

主要モデルの中で最速、Mistralのフラッグシップモデル「Mixtral」

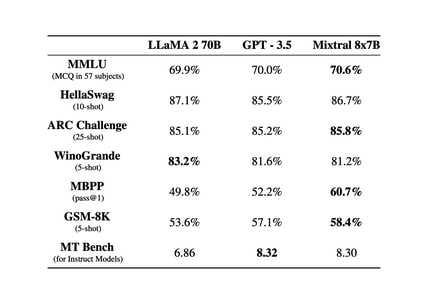

AWSとマイクロソフトの両社がMistralのモデルを自社クラウドサービスに導入した主な理由は、MistralのAIモデルにおける技術的優位性だろう。以下では、Mistral社が最近リリースした2つのフラッグシップモデル「Mixtral 8x7B」と「Mistral Large」について解説したい。 Mixtral 8x7Bは、2023年12月に発表されたオープンソースモデル。Llama2 70Bを上回る性能と6倍の推論速度を実現。Apache 2.0ライセンスの下で提供され、GPT-3.5に匹敵、あるいは上回るコストパフォーマンスを誇る。Apache 2.0ライセンスとは、オープンソースソフトウェアで広く使われているライセンスの1つで、商用・非商用を問わず、誰でも自由に使用、変更、配布することが可能だ。 Mixtral 8x7Bは3万2,000トークンのコンテキストに対応し、英語、フランス語、イタリア語、ドイツ語、スペイン語での応答に優れ、コード生成にも強みを持つ。多様なタスク能力を測るベンチマークテスト「MT-Bench(Multi-Task Benchmark)」では8.3のスコアを達成した。これはOpenAIのGPT‐3.5と同等の能力となる。 混合エキスパートアーキテクチャを採用しており、560億相当のパラメータを持ちながら、70億相当のコストと速度で動作する。これによりトレーニングと推論を大幅に高速化できる。 Artificial Analysisのまとめでは、1秒あたりに処理できるトークン数は、Mixtral 8x7Bが117トークンとなり、主要モデルの中で最速であることが判明した。OpenAIのGPT‐3.5 Turboが63トークンであることを鑑みると、Mixtral 8x7Bが如何に高速なのかがわかる。メタのフラッグシップモデルLlama 2との比較では、特にコードと数学分野で大きくリードし、効率性でも優位に立つ。多言語ベンチマークではLlama 2 70Bをしのぐスコアをたたき出している。 速度を重視するアプリケーション開発に最適なモデルといえるが、日本語に対応していないなどの弱点を持っており、今後の改善に期待が寄せられる。