落胆招いたグーグルGemini、期待と実力のギャップが理由か? OpenAIとの差を埋める取り組み最先端

GeminiとはどのようなAIモデルなのか?

グーグルが新たに生成AIモデル「Gemini」を発表した。OpenAIのGPT-4を意識した高い推論能力を売りとするAIモデルで、実際どれほどの実力を有するのかに注目が集まっている。 OpenAIの生成AIチャットモデルにGPT-3.5やGPT-4などといくつかのグレードがあるように、Geminiにも4つのグレードが存在する。AIモデルサイズの順に「Gemini Nano-1」「Gemini Nano-2」「Gemini Pro」「Gemini Ultra」の4つだ。 Geminiが注目される理由は、サイズが最も大きい最上位モデルとなるGemini Ultraが複数のベンチマークテストにおいて、現在市場で最も優れているといわれるOpenAIのGPT-4を超えたとされるからだ。

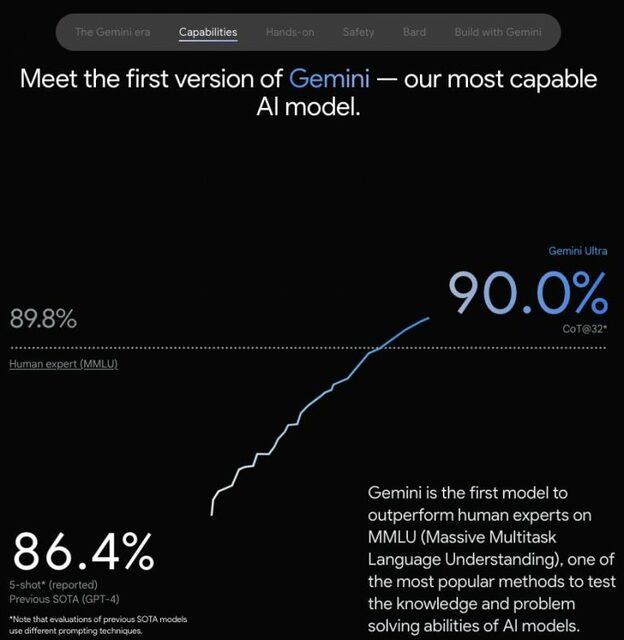

GPT-4に対するGemini Ultraのベンチマークスコアは、テクニカルレポートのほか、Geminiの発表ページでも大々的に強調されており、それがメディアや公衆の関心を引いた。実際どのようなベンチマークスコアが示されているのか、グーグルが発表したテクニカルレポートを参考に見ていきたい。 まずテキスト生成での、AIモデルの言語理解能力を図るMMLU(Massive Multitask Language Understanding)テストでは、GPT-4が86.4%だったのに対し、Gemini Ultraは90%を獲得した。MMLUとは、文学、歴史、科学、数学など57の異なる分野の知識を評価するデータセットで、特にAIモデルが多様なタスクにどれほど対応できるのかを広範に評価するものとなる。 Gemini Ultraが90%を獲得したということは、MMLUが提供するタスクや問題の90%を正確に回答できたことを意味する。グーグルによるGeminiのテクニカルレポートでは、このMMLUテストにおける他モデルの結果も示されている。その結果は以下のようになった。 OpenAI、GPT-3.5:70% グーグル、PaLM2:78.4% Anthropic、Claude2:78.5% InflectionAI、Inflection-2:79.6% xAI、Grok1:73 メタ、Llama-2:68% テキスト生成ではMMLUを含め9つのベンチマークテストが実施されたが、Gemini Ultraはとりわけ算数・数学とコーディングで高い能力を発揮できる可能性が示されている。 たとえばGSM8Kテストでは、Gemini Ultraは94.4%という100%に近いスコアを獲得し、GPT-4の92%を上回った。GSM8K(Grade School Math 8K)とは、8000の小学校レベルの算数・数学問題によって構成されるデータセットで、AIの数学的推論能力を評価する際に広く用いられている。 また高等数学を対象とするベンチマークテストMATHでもGemini Ultraは、GPT-4(52.9%)を上回る53.2%を獲得。MATHは他モデルが20~30%台で苦戦する難しいベンチマークテストであるが、その中で50%を超えたことはGPT-4とともに特筆されるべきだろう。 ほとんどのベンチマークテストでGemini UltraはGPT-4を上回っているが、その差は数ポイントにとどまる。 唯一7ポイント以上の差で、GPT-4を超えたのがコーディング能力を評価するHumanEvalだ。GPT-4が67%だったのに対し、Gemini Ultraは74.4%を獲得。このベンチマークテストは、関数の実装、アルゴリズムの問題解決、データ処理タスクなど、幅広いコーディングのスキルを要求するもの。グーグルのテクニカルレポートによると、このベンチマークでの最高値はGemini Ultraの74.4%。これにAnthropicのClaude2が70%、GPT-4が67%、Grok 1が63.2%、GPT-3.5が48.1%などと続く。