「公開するApple vs. 隠すOpenAI」アップルが300億パラメータのマルチモーダルAI「MM1」発表。重要論文5本を解説(生成AIウィークリー)

1週間分の生成AI関連論文の中から重要なものをピックアップし、解説をする連載です。第38回目は、生成AI最新論文の概要5つを紹介します。 生成AIグラビア 写真集

Appleが最大300億パラメータを持つマルチモーダル大規模言語モデル「MM1」を開発

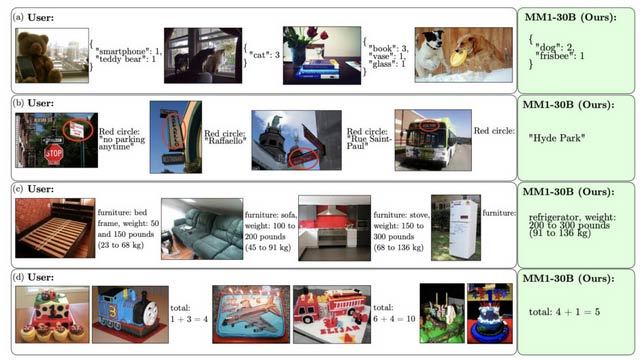

既存のマルチモーダル大規模言語モデル(MLLM)は、透明性の観点からクローズドモデルとオープンモデルの2つに分類できます。どちらのモデルも、マルチモーダル事前学習に関するアルゴリズム設計の選択肢に至るまでのプロセスについては、ほとんど公開していません。つまり、モデルの最終的な構成については情報が提供されていても、そこに至るまでの試行錯誤や意思決定プロセスは明らかにされていないのが現状です。 そこでAppleは、高性能なMLLMを探るべく、モデルの構造や学習に使うデータの選び方がモデルの性能にどのように影響するかなどを詳しく分析した論文を公開しました。研究チームはアブレーション実験を行い、分析した結果、モデルアーキテクチャの決定や事前学習データの選択などにおいて、いくつか重要なポイントがわかりました。 例えば、画像とキャプション、画像と文章が混ざったデータ(インターリーブ画像テキストデータ)、文章だけのデータを上手に組み合わせて事前学習を行うことが、少ない例でも高い性能を出すために大切だということがわかりました。 また、モデルの性能には、画像エンコーダの損失と容量、画像の解像度(高い解像度が良い)、画像エンコーダを事前学習するために使用されるデータの種類や量が大きく影響することがわかりました。一方で、画像と言語をつなぐ部分の設計はあまり重要ではないことがわかりました。 これらの知見などを基に、研究チームは3B(30億)、7B(70億)、30B(300億)のパラメータを持つMLLMファミリー「MM1」を構築。アーキテクチャでは、事前学習済みの画像エンコーダと言語モデルを組み合わせています。画像エンコーダにはCLIP等で学習したViT(Vision Transformer)、そしてC-Abstractorを使用しています。 事前学習データでは、キャプション付き画像データ(45%)、インターリーブ画像テキストデータ(45%)、テキストのみデータ(10%)の割合で組み合わせています。知見の一つに、インターリーブ画像テキストデータとテキストのみデータは、few-shotとテキストのみのタスクの性能に重要であるのに対し、キャプションデータはzero-shotの性能向上に寄与することが示されています。 MM1は、「mixture-of-experts」(MoE)も導入しています。指示ファインチューニングでは、GPT-4および GPT-4Vで生成されたデータ(例えばShareGPT-4V)や、VQAv2、GQA、OKVQA、COCO Captions、TextCaps、DVQA、ChartQA、AI2Dなど多数のデータセットを使用しています。 評価実験では、事前学習の指標で30BでSOTAを達成し、3Bや7Bのモデルサイズでも同等のサイズの他のモデルと比較して高い性能を達成しました。また指示ファインチューニング後のモデルでは、12のマルチモーダルベンチマークで競争力のある性能を示しました。

【関連記事】

- 「公開するApple vs. 隠すOpenAI」アップルが300億パラメータのマルチモーダルAI「MM1」発表。重要論文5本を解説(生成AIウィークリー)

- Apple Car開発プロジェクト中止か。AIに資源集中のためとBloomberg報じる

- GPT-4のコード生成精度を2倍以上向上させる「AlphaCodium」、写真1枚から本人性を維持した画像を量産できる「InstantID」など重要論文5本を解説(生成AIウィークリー)

- アップル、独自生成AI「Apple GPT」のため出版社や報道機関とライセンス交渉中? NY Timesほか報道

- アップル、独自の大規模言語モデル「Apple GPT」を社内でテスト中?製品組み込みは慎重、2024年には発表の可能性(Bloomberg報道)