複数の同一人物を同時に量産できるNVIDIAの画像生成AI「ConsiStory」、Gemini UltraやGPT-4に匹敵する数学特化のオープンソース言語モデル「DeepSeekMath」など重要論文5本を解説(生成AIウィークリー)

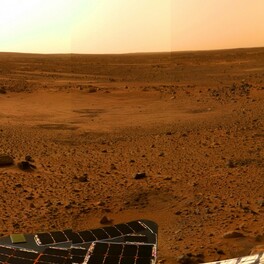

1週間分の生成AI関連論文の中から重要なものをピックアップし、解説をする連載です。第33回目は、生成AI最新論文の概要5つを紹介します。 高解像度の3Dモデルを数秒で生成するモデル「LGM」【画像】

訓練なしで複数キャラを同時に異なるプロンプトで量産できる画像生成AI「ConsiStory」、NVIDIAなどが技術開発

ConsiStoryは、テキスト指示に基づいて画像を生成する際、同じキャラクター(人物や動物、物など)を異なるシナリオで一貫して描画する技術です。この技術により、同一キャラクターの異なる画像を、異なるプロンプトに応じて、細部に至るまで一貫性を保ちながら量産することが可能です。 従来は事前学習や個別にモデルを微調整することで、人物ごとの長期にわたる最適化や大規模な事前トレーニングを必要としていましたが、ConsiStoryはその手間を解決します。また従来の手法では難しかった、複数のキャラクターを一貫して描画することもできます。 この手法は、まず生成された画像内のキャラクターを特定し、これらのキャラクター情報を画像間で共有することで、一貫したキャラクターの表現を強化します。キャラクター間の視覚的一貫性を高めるために、一つの画像から別の画像へ特定の特徴を注入します。さらに、レイアウトの多様性を保つための戦略を採用し、生成される画像が一貫性を保ちつつも、異なるシナリオや背景を持つことができるようにしています。 ConsiStoryは、既存の画像編集ツールとも互換性があり、生成した画像に対してさらに細かい編集を行うことが可能です。これにより、ユーザーは、事前学習や微調整なしに、テキストから被写体を固定した異なるシナリオの高品質な画像コンテンツを生成することができます。

“あいまいな言葉”で画像を合理的に編集できるモデル「MGIE」、Appleなどが開発

UC Santa BarbaraやAppleなどの研究者たちは、マルチモーダル大規模言語モデル(MLLM)を基にした画像編集手法「MGIE」(MLLM-Guided Image Editing)を開発しました。 MGIEは、MLLMを活用して入力された抽象的な自然言語によるテキストからより詳細で具体的な編集指示を導き出します。これにより、編集目標に対する明確な視覚関連のガイダンスが提供され、拡散モデルを用いたエンドツーエンドのトレーニングを通じて、意図した画像編集が実現されます。 MGIEは、画像の切り取りや明るさ、コントラスト調整などの一般的な画像編集から、画像内の特定のオブジェクトの削除や追加などの部分的な編集まで行えます。これらの編集は、不正確であいまいなテキストでも視覚的に理解し、適切に解釈して編集を行います。 例えば、「プロフェッショナルに見せて」「図書館のようにして」「ヘルシーにして」「バチカンのようにして」などの抽象的な命令に対しても合理的な画像編集を行います。これにより、ユーザーは直感的に画像を編集できるようになります。 実験結果は、自動評価指標と人間による評価の両方で、MGIEが指示に基づく画像編集を顕著に改善し、視覚に関するガイダンスがこの改善に不可欠であることを示しています。

【関連記事】

- 複数の同一人物を同時に量産できるNVIDIAの画像生成AI「ConsiStory」、Gemini UltraやGPT-4に匹敵する数学特化のオープンソース言語モデル「DeepSeekMath」など重要論文5本を解説(生成AIウィークリー)

- アップル、文章で画像を編集するAIモデル「MGIE」開発。GitHubにオープンソース公開

- スマホ高品質画像生成、わずか0.2秒で。Google「MobileDiffusion」がiPhone 15 Proで達成。重要論文5本を解説(生成AIウィークリー)

- Amazonが服の仮想試着AI「Diffuse to Choose」、画像内の物体分離指示できる「Grounded SAM」、動画の高品質な奥行き推定「Depth Anything」など重要論文6本を解説(生成AIウィークリー)

- GPT-4のコード生成精度を2倍以上向上させる「AlphaCodium」、写真1枚から本人性を維持した画像を量産できる「InstantID」など重要論文5本を解説(生成AIウィークリー)