生成AIをめぐる規制動向、世界各国はAI原則を共有しつつ、それぞれの思惑反映した枠組みを導入

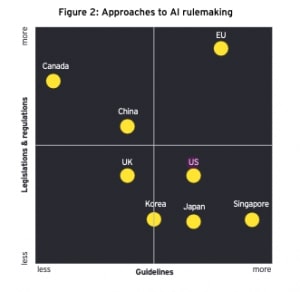

AI市場の成長ポテンシャルとリスク

ChatGPTが火付け役となった生成AIトレンドだが、その市場成長ポテンシャルに関する予測レポートが多数発表されている。 たとえば、コンサルティング大手マッキンゼーが2023年6月に発表したレポートでは、生成AI活用による生産性向上により、2045年頃には最大で年間4兆4,000億ドルもの経済価値が追加される可能性があると予想されている。 また、Furtune Business Insightsは、2023年の生成AI市場規模を438億7,000万ドルと推計した上で、今後47.5%の年間成長率で拡大し、2030年には6,679億6,000万ドルに達すると予想している。 こうした強気の市場予測を背景に、現在テック大手を中心に生成AI関連の投資や研究開発が活発化しており、この勢いは2024年以降さらに加速する公算が高まっている。 一方で生成AIを含むAIテクノロジーに潜むリスクに対する懸念も増大しており、リスク最小化に向けた取り組みも国家アクターを中心に拡大しつつある。 ビッグ4会計大手の1つアーンスト・アンド・ヤング(EY)が2023年9月に発表したレポートによると、国家アクターによるAI規制議論において、複数の共通項が確認されるという。 1つは、各国では、OECDが定義しG20によって採択されたAI原則に沿った形で、AI規制・ガイダンス議論が進められているということ。この原則には、人権やサステナビリティ、透明性の尊重、また強力なリスク管理が含まれる。 もう1つの共通項は、AI規制において、各国がリスクベースのアプローチを採用しているということだ。 リスクベースのアプローチとは、AI規制・管理において、AIシステムの潜在的なリスクの程度に基づいて当局が異なる対応をとるアプローチを指す。 過去においては、新たなテクノロジーが登場した際、企業や業界団体による自主的な規制やガイドラインに依拠したものや規制の障壁を最小に抑えるイノベーション志向のものなどさまざまなアプローチがあった。一方で、AIテクノロジーの性質から、現在世界各地ではリスクベースのアプローチが趨勢となっているのだ。 このリスクベースに関する議論で最も進んでいるのが欧州連合(EU)。欧州議会では、AI規制に向け新たな法律「AI Act」が提案され、今後複数の議論と段階を経て施行される予定となっている。 現在までの議論で、リスクは「受け入れられないリスク」「高リスク」「限定的かつ最小のリスク」の3段階に分類され、それぞれに異なる対応が検討されている。 リスクレベルが最高となるのは「受け入れられないリスク」。たとえば、子どもに危険な行動を促す音声認識型のおもちゃ、行動・社会経済的地位・個人的特性に基づいて人々を分類するソーシャルスコアリング、顔認識を含むリアルタイムや遠隔での生体認識システムが含まれており、これらは完全に禁止される。 これに次ぐ「高リスク」に分類されるAIツールは、完全禁止とはならないものの、市場に出る前に厳しい審査・評価が求められる。企業が展開する人材採用AIシステムなど、個人の生活を大きく変えてしまうようなAI意思決定システムなどが対象となる。 「限定的かつ最小のリスク」には、Eメールのスパムフィルタなど悪影響が小さなAIシステムが含まれる。 EYは同レポートで、法律・規制量とガイドライン量の2軸で主要国のAI規制アプローチをマッピングしているが、法律・規制とガイドラインの両軸で多いのがEUであり、世界の中で最も厳しいアプローチをとっていることを示唆するものとなっている。法律・規制の軸では、EUのほかカナダと中国が比較的厳しいアプローチをとっている。 一方、法律・規制ではなく、ガイドラインによるアプローチをとっている国も存在する。ガイドラインの多さでは、シンガポールが最多となり、これにEU、米国、日本、韓国、英国が続く格好となる。