「ChatGPTは凡庸な悪」言語学の大家、チョムスキー氏が指摘する、その本当の問題とは?

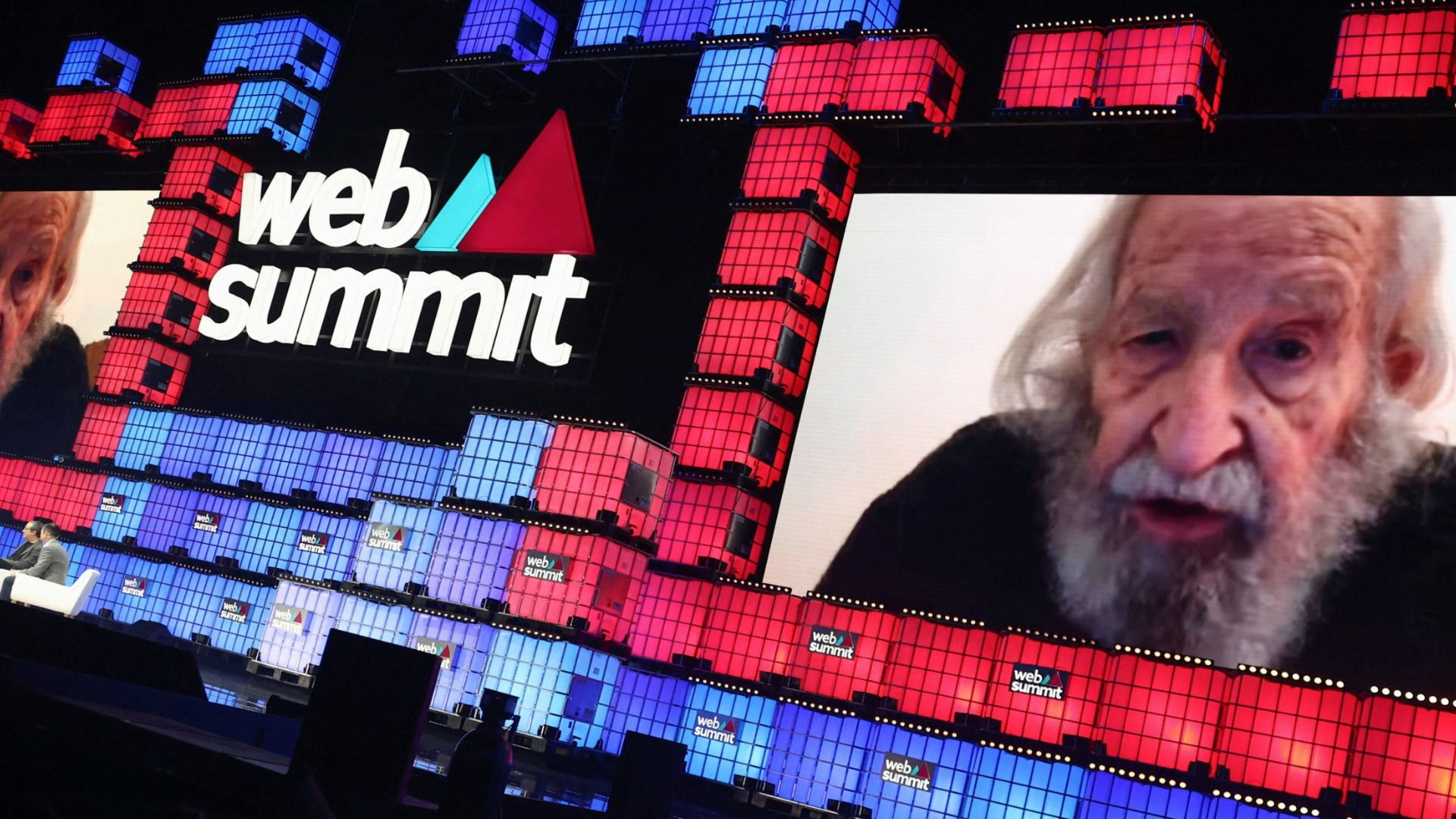

チャットGPTは「凡庸な悪」だと、世界的な言語学の大家が指摘し、話題を呼んでいる。

「現代言語学の父」と称されるノーム・チョムスキー氏は3月8日付のニューヨーク・タイムズへの寄稿の中で、チャットGPTなどへの熱狂ぶりに警鐘を鳴らす。

寄稿では、膨大な情報を学習した大規模言語モデルと言われるAIを「機械学習の驚異」としながら、「疑似科学だ」とも断じる。

一方で、テクノロジーの思想家として知られるシリコンバレーの論客、ケヴィン・ケリー氏は、「問題はAIではなく、私たち自身だ」と述べている。

チャットGPTが抱える、本当の問題点とは?

●「知性」と「道徳的無関心」

オープンAIのチャットGPT、グーグルのバード(Bard)、マイクロソフトのシドニー(Sydney)は機械学習の驚異だ。(中略)これらのプログラムは、汎用人工知能の地平線を照らす最初の兆し、と称えられている。機械の心が人間の脳を超える、長く予言された瞬間だ。それは、処理速度やメモリサイズといった量的な面だけでなく、知的洞察力や芸術的創造性といった、あらゆる人間特有の能力をもしのぐということだ。

チョムスキー氏は、ケンブリッジ大学教授(言語学)イアン・ロバーツ氏、テクノロジー企業「オーシャンイット」のAIディレクター、ジェフリー・ワトゥムル氏と連名で、3月8日にニューヨーク・タイムズに掲載した寄稿の中で、そう述べている。寄稿はこう続く。

そんな日が、いずれは来るのかもしれないが、夜明けはまだ先だ。大げさな見出しや、見境のない投資話の皮算用と、現実は大違いだ。

94歳のチョムスキー氏は、「生成文法」の提唱などで知られ、「現代言語学の父」と呼ばれる。一方で左派知識人として活発な社会活動でも存在感を示してきた。

チョムスキー氏らはニューヨーク・タイムズの寄稿で、注目を集めているチャットGPTなどのプログラムの問題点を指摘する。

チャットGPTは、2022年11月30日のサービス公開から5日でユーザー数は100万人を突破。2023年1月の月間ユーザー数は1億人に達するという人気ぶりだ。

チャットGPTは大規模言語モデルのGPT-3.5をベースにしているが、早くも最新版のGPT-4の公開をめぐる報道もある。

グーグルは2月6日に自社のチャットAI「バード」を発表。マイクロソフトもその翌日、提携先であるオープンAIの「次世代モデル」を自社検索エンジン「ビング」に搭載したことを発表している。その開発用コードネームが「シドニー」だ。

IT業界の潮流は、「Web3」や「メタバース」から、一気にチャットAIへと舵を切り、過熱している。

チョムスキー氏らは、その火付け役となったチャットGPTなどの問題は、「知性」が欠落している点にあるという。

極めて深刻な欠陥は、知性の最も重要な能力を欠いていることだ。その事象はどんなことか、過去にどうだったか、今後どうなるか、という記述と予測の能力だけでなく、何がその事象ではないのか、そしてその事象の可能性があるものとは何か、可能性のないものとは何か、ということを説明する能力がないのだ。それらは説明という能力の構成要素であり、真の知性の証だ。

チャットGPTなどのAIは、膨大なデータで学習し、それを基に、可能性の高い言葉のつながりを次々と文章にしていく。チャットGPTの土台となったGPT-3の場合、その学習データ量は570ギガバイトに上る。

しかし、文章の意味や真偽、事柄の因果関係などは判断していないため、しばしば虚偽の内容や奇異な文章を出力する、「幻覚」と呼ばれる現象が起きる。

※参照:「恐怖すら感じた」AIが記者に愛を告白、脅迫も 「チャットGPT」生みの親が警戒する「怖いAI」(02/27/2023 AERAdot)

寄稿の共著者の1人、ワトゥムル氏との「道徳」をめぐる問答の中で、チャットGPTは「AIである私は、道徳的信念も道徳的判断を下す能力も持っていないので、不道徳であるとも道徳的であるとも言えない。私が道徳的信念を持たないのは、単に機械学習モデルとしての私の性質の結果だ」と回答している。

この問答について、チョムスキー氏らは寄稿の中で、こう指摘する。

一見、洗練された思考と言語だが、知性の欠如から生まれる、道徳への無関心に注目してほしい。ここでチャットGPTは、盗用と無関心と疎外化という、悪の凡庸さのようなものを示している。文献にある標準的な議論を一種のスーパーオートコンプリートで要約し、何に対しても立場を取ることを拒否し、単なる無知ではなく知性が欠如しているのだと主張し、最終的には「命令に従っただけ」という弁明を行い、責任をその開発者に転嫁している。

「悪の凡庸さ(陳腐さ、banality of evil)」は、思考停止と規範への従属が引き起こす悪を指す。

政治哲学者、ハンナ・アーレントによる、ナチス・ドイツのユダヤ人抹殺計画立案者、アドルフ・アイヒマンの裁判傍聴をまとめた1963年の著書『エルサレムのアイヒマン――悪の陳腐さについての報告』で示された。アーレントはドイツのユダヤ人家庭の生まれで、裁判傍聴のいきさつは「ハンナ・アーレント」(マルガレーテ・フォン・トロッタ監督)として映画化もされた。

チョムスキー氏は米国生まれだが、ユダヤ系移民の両親を持つ。

チャットGPTは、とかくその「万能さ」が喧伝され、そこに「知性」を投影してしまいがちだ。だが、「知性」の中核となるべき価値判断能力の部分は「空洞」だ。

チョムスキー氏らの指摘は、チャットGPTの回答ぶりから、「知性」よりも、むしろ有害な「思考停止」や「規範への従属」の影が浮かんでくる、ということのようだ。

チョムスキー氏らは寄稿の中で「盗用」という表現を使っている。チャットGPTのような生成AIをめぐっては、学習データとして使われたネット上のコンテンツの著作権侵害を指摘する声がある。

チャットGPTなどの生成AIの広がりは、事実関係や倫理を逸脱した情報が膨張していくリスクも意味する。

チョムスキー氏らは、それらを「疑似科学」と呼び、そんな事態に警鐘を鳴らす。

●「劣化コピー」の広がりとリスク

映画「メッセージ」(ドゥニ・ヴィルヌーヴ監督)の原作『あなたの人生の物語』などで知られるSF作家のテッド・チャン氏も、2月9日付のニューヨーカーへの寄稿で、チャットGPTについて取り上げている。

チャン氏はこの中で、チャットGPTの情報の精度について「ぼやけたJPEG」という表現を使う。

チャットGPTがネット上の膨大な情報を再パッケージ化する中で、劣化コピーのような情報の「圧縮」、すなわち間引きが行われているとする。

そして劣化コピーとしての情報の氾濫に、やはり危機感を示している。

大規模言語モデルによって生成されたテキストがウェブ上で公開されればされるほど、ウェブはさらにぼやけたものになっていく。

※参照:生成AIで間違いだらけの健康コンテンツ、「もっともらしいデタラメ」の本当のリスクとは?(02/13/2023 新聞紙学的)

それだけではない。チャットGPTなどが悪意をもって使われた場合のリスクもある。

セキュリティ専門家として知られるブルース・シュナイアー氏は、データサイエンティストのネイサン・サンダーズ氏とともに、1月15日付のニューヨーク・タイムズへの寄稿「チャットGPTは民主主義をいかにハイジャックするか」の中で、こう指摘している。

チャットGPTなら、政府の規制策定のプロセスで提出されるパブリックコメントを、自動的に作成できる。ローカル紙に掲載させるために、編集者に宛てた投書の作成もできる。ニュース記事やブログ投稿、ソーシャルメディアの投稿に対して、1日に何百万回もコメントすることができる。ロシアのインターネット・リサーチ・エージェンシー(IRA)は、2016年の米大統領選に介入しようとしたが、チャットGPTも同じようなことが可能だ。ただし、IRAが使ったと報じられているような、数百万ドルの予算と何百人もの従業員は必要ない。

ロシアのインターネット・リサーチ・エージェンシーとは、フェイクニュース拡散などによって2016年の米大統領選に介入したとされるロシア・サンクトペテルブルクの専門業者。「プーチンの料理人」と呼ばれるロシアのプーチン大統領の側近、エフゲニー・プリゴジン氏が実質的オーナーとされる。

※参照:ロシアの「フェイクニュース工場」は米大統領選にどう介入したのか(02/18/2018 新聞紙学的)

チャットGPTを使えば、米大統領選介入と同じような情報工作が、はるかに安価にできてしまう、とシュナイアー氏らは指摘する。

同様のリスクは、チャットGPTの開発元であるオープンAIが、スタンフォード大学、ジョージタウン大学とともに、その4日前の1月11日に公表した調査報告書でも指摘されている。

※参照:生成AIが世論操作のコスパを上げる、その本当の危険度とは?(01/20/2023 新聞紙学的)

AIの加速度的な進化には、多くの人が不安を覚える。

米モンマス大学が2月15日に発表した世論調査結果によると、米国人の60%はチャットGPTについて聞いたことがあり、72%はすべてのニュース記事がAIによって書かれる時代が来ると考えていた。しかし、78%はそれが「悪いこと」だと捉えていたという。

AIによる社会へのインパクトでは、「良いことと悪いことが同じ」が46%、「悪いことの方が多い」が41%、「良いことの方が多い」は、わずか9%だったという。

1987年に実施された同種の世論調査では、「良いことと悪いことが同じ」は29%、「悪いことの方が多い」は39%、「良いことの方が多い」は20%だったという。

●「問題は私たち」

AIの効果については、すでに100年前から議論されている。(中略)長いリハーサルの欠点は、成功よりも失敗のシナリオの方がずっと多いということだ。あらゆる恐ろしいシナリオを考える時間があったために、ポジティブな予測は、神話のように非現実的に感じられてしまうのだ。

テックカルチャー雑誌「ワイアード」の創刊編集長で、テクノロジーの思想家として知られるケヴィン・ケリー氏は、ブロガーのノア・スミス氏による3月7日付のインタビュー記事で、AIへのネガティブな受け止め方について、そう述べている。

※参照:「不可避な未来」と選び取る現実:ケヴィン・ケリー氏の描く2050年(07/24/2016 新聞紙学的)

※参照:ケヴィン・ケリーさんに聞く:テクノロジーはチャンスを生み出す、たくさんの失敗をせよ(10/12/2014 新聞紙学的)

ケリー氏がいう「100年前」とは、AIをめぐる議論の源流としての、1920年代のロボットブームを指すようだ。

チェコのカレル・チャペックが戯曲『ロボット(R.U.R.)』で「ロボット」という言葉を創り出し、人間に対する反乱を描いたのが1920年。アンドロイドが労働者の暴動を扇動する、フリッツ・ラング監督によるドイツのSF映画「メトロポリス」が公開されたのは1927年だった。

※参照:メディア報道から見る「AIへの“違和感”」(03/25/2022 桜美林大学研究紀要.社会科学研究 第2号(2021年度)pp.339-347)

ケリー氏は自らを「急進派オプティミスト」と呼び、「テクノロジーの問題を解決できるのはテクノロジーだけだ」という。そして、「私たちは変化について、短期的には過大に見積もり、長期的には過小に見積もる傾向がある」とも述べる。

その上で、ケリー氏はこう指摘している。

AIは平均的な人間による仕事から学習しているため、平均的な人間の偏見や先入観、弱点、悪癖を露呈してしまう。(中略)問題はAIではない。問題は、AIが私たち自身の、浅薄で一貫性のない倫理観を明らかにしてしまったことだ。AIを私たちよりも優れたものにしようとするなら、それは膨大な作業になる。

オプティミストとしてのケリー氏は、AIを「インターン」に見立てる。

チャットGPTや(オープンAIの画像生成AI)ダリ(DALL·E)のような原始的なAIエージェントの第1弾は、汎用のインターンと考えるのが一番だ。今年初めてAIを利用した何百万人もの人々は、もし個人的なインターンがいたらさせるようなことを、実際にさせているようだ。つまり、草稿を書かせる、コードを提案させる、研究の要約をさせる、スピーチのレビューをさせる、アイデアをブレストする、(デザインのイメージ共有のための)ムードボードを作らせる、見出しを提案させる、といったことだ。インターンなのだから、その仕事はチェックとレビューの必要があるし、それによって改善できる。だが、AIインターンの作品をチェックなしに公開してしまえば厄介事になるのは、すでに見ての通りだ。

●「凡庸な悪」と「インターン」の間

チャットGPTなどのチャットAIは、その使い勝手のシンプルさで、一般ユーザーのAI利用のハードルを劇的に下げた。

しかしその熱狂は、AIの「万能さ」をことさらクローズアップする。

熱狂の中で、AIに人間的な判断能力まで仮想しがちだが、それは電卓に未来を占ってもらうような面もある。真ん中が「空洞」のAIに過剰な期待を寄せるバブルは、「凡庸な悪」の影も引きずる。

一方で、チャットAIを不慣れな「インターン」として、使いどころをわきまえていれば、無用な混乱は抑えられるのかもしれない。

「凡庸な悪」と「インターン」の間を、チャットGPTは行きつ戻りつしている。

(※2023年3月13日付「新聞紙学的」より加筆・修正のうえ転載)